本网站正在使用安全服务来抵御在线攻击。您刚才的操作触发了安全防御机制。触发此拦截的原因可能有多种,包括提交了特定的词汇或短语、SQL 命令或格式错误的数据。

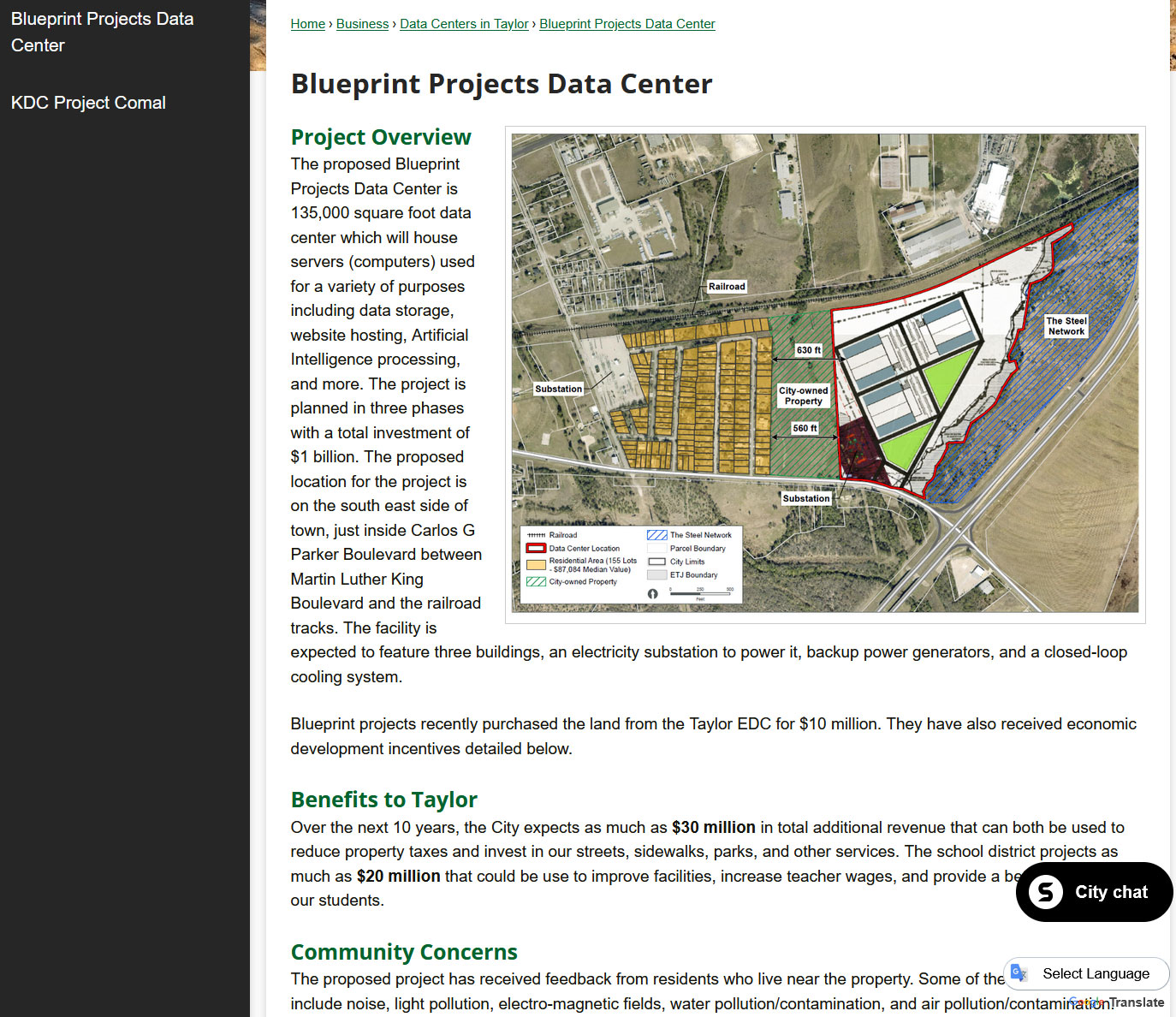

1999年,一位农民以10美元的象征性价格向得克萨斯州泰勒市捐赠了87英亩土地,并在契约中规定该地产必须专门用作公园用地。尽管有此明确指示,这块土地在多次易手后,于2025年被泰勒经济发展公司以1000万美元的价格卖给了一家开发商,用于建造大型数据中心。

以帕梅拉·格里芬(Pamela Griffin)为首的当地居民对这种违背捐赠者初衷的行为感到愤怒,并对噪音、环境影响和房产价值表示担忧。尽管市议会声称受现有分区法限制无力阻止开发,并辩称由此产生的3000万美元税收将惠及学区,但居民们并不买账。

在初步法律诉讼失败后,当地居民现正将斗争升级至第三上诉法院。他们诉讼的核心依据是1999年的原始契约,他们认为该契约构成了一项必须遵守的具有约束力的信托。这场纠纷凸显了市政经济发展与维护社区土地承诺之间日益紧张的关系。

1999年,一位农民以10美元的象征性价格向得克萨斯州泰勒市捐赠了87英亩土地,并在契约中规定该地产必须专门用作公园用地。尽管有此明确指示,这块土地在多次易手后,于2025年被泰勒经济发展公司以1000万美元的价格卖给了一家开发商,用于建造大型数据中心。

以帕梅拉·格里芬(Pamela Griffin)为首的当地居民对这种违背捐赠者初衷的行为感到愤怒,并对噪音、环境影响和房产价值表示担忧。尽管市议会声称受现有分区法限制无力阻止开发,并辩称由此产生的3000万美元税收将惠及学区,但居民们并不买账。

在初步法律诉讼失败后,当地居民现正将斗争升级至第三上诉法院。他们诉讼的核心依据是1999年的原始契约,他们认为该契约构成了一项必须遵守的具有约束力的信托。这场纠纷凸显了市政经济发展与维护社区土地承诺之间日益紧张的关系。

πfs 是一个概念性的文件系统,它利用圆周率 π 的数学特性来实现“100% 压缩”。基于 π 是正规数的猜想,它包含了所有可能的有限数字序列——这意味着每一个可能的文件都已经存在于 π 的无限小数展开式中的某个位置。 πfs 不使用传统存储方式,而是通过 Bailey–Borwein–Plouffe 公式存储元数据(文件的索引和长度)来定位 π 中的数据。通过将文件拆分为单个字节并编排其位置,该系统避免了物理存储需求。尽管目前的原型系统比传统文件系统慢得多,但开发人员表示,未来的优化方案(如并行查找和改进的搜索算法)可能会使这种“无限存储”方法更具实用性。 归根结底,πfs 将重点从存储实际数据转移到了管理元数据上,这些元数据是定位并提取隐藏在 π 这片无限信息海洋中所需的海量信息。

在这篇文章中,维克多·戴维斯·汉森认为,现代左翼运动(包括“我也是”(#MeToo)、“黑人的命也是命”(Black Lives Matter)以及各类环境与社会运动)本质上是周期性的“道德十字军”,它们最终不可避免地会沦为自我讽刺并对国家造成损害。

汉森主张,这些诞生于富裕大学和媒体圈的运动,将政治功利置于真相之上。他引用了对民主党人物性行为不端指控的处理不一致,以及围绕著名的“黑人的命也是命”案件所存在的谎言,作为意识形态虚伪性的证据。他进一步指出,这些从“削减警察经费”和多元、公平与包容(DEI)倡议,到边境政策和跨性别权益倡导等“生存心理剧”,都是由精英阶层推动的议程,旨在瓦解传统的西方制度。

据汉森所言,这些潮流导致了巨大的社会成本,如犯罪率上升、经济不稳定以及社会凝聚力的破碎。他总结认为,这些运动最终正在走向失败,因为公众正日益拒绝这种“周期性的、集体的自杀式疯狂”。他提出,一股日益壮大的公民反抗力量正在积极反击,决心捍卫那些精英阶层试图破坏的传统、安全与自由。

在这篇文章中,维克多·戴维斯·汉森认为,现代左翼运动(包括“我也是”(#MeToo)、“黑人的命也是命”(Black Lives Matter)以及各类环境与社会运动)本质上是周期性的“道德十字军”,它们最终不可避免地会沦为自我讽刺并对国家造成损害。

汉森主张,这些诞生于富裕大学和媒体圈的运动,将政治功利置于真相之上。他引用了对民主党人物性行为不端指控的处理不一致,以及围绕著名的“黑人的命也是命”案件所存在的谎言,作为意识形态虚伪性的证据。他进一步指出,这些从“削减警察经费”和多元、公平与包容(DEI)倡议,到边境政策和跨性别权益倡导等“生存心理剧”,都是由精英阶层推动的议程,旨在瓦解传统的西方制度。

据汉森所言,这些潮流导致了巨大的社会成本,如犯罪率上升、经济不稳定以及社会凝聚力的破碎。他总结认为,这些运动最终正在走向失败,因为公众正日益拒绝这种“周期性的、集体的自杀式疯狂”。他提出,一股日益壮大的公民反抗力量正在积极反击,决心捍卫那些精英阶层试图破坏的传统、安全与自由。

据报道,OpenAI 正商讨在俄亥俄州的联邦土地上租赁一个规模达 10 吉瓦的数据中心园区,该项目可能由英伟达提供支持。据估计,该项目成本将超过 5000 亿美元,若建成,将成为历史上规模最大的数据中心开发项目,其第一阶段目标是在 2028 年投入使用。该设施所需的电力极其巨大,相当于几座核电站或大型燃气发电厂的总和。

与此同时,俄亥俄州立法者提出了第 646 号众议院法案,旨在监管该州蓬勃发展的数据中心行业。该立法寻求建立一个新的电价类别,确保超大规模数据中心运营商(而非当地纳税人)承担其所产生的基础设施和电网压力带来的全部成本。

这一提案正值全球数据中心资本支出激增之际,但该行业也正面临越来越多的阻力。由于当地对资源消耗、电力可靠性和电网压力的担忧,全球各地的项目频繁出现延期或取消。此外,在 OpenAI 发布此消息之前,该公司刚提交了 IPO 初稿,这标志着这家人工智能巨头在扩大基础设施需求方面迈出了重要一步。

据报道,OpenAI 正商讨在俄亥俄州的联邦土地上租赁一个规模达 10 吉瓦的数据中心园区,该项目可能由英伟达提供支持。据估计,该项目成本将超过 5000 亿美元,若建成,将成为历史上规模最大的数据中心开发项目,其第一阶段目标是在 2028 年投入使用。该设施所需的电力极其巨大,相当于几座核电站或大型燃气发电厂的总和。

与此同时,俄亥俄州立法者提出了第 646 号众议院法案,旨在监管该州蓬勃发展的数据中心行业。该立法寻求建立一个新的电价类别,确保超大规模数据中心运营商(而非当地纳税人)承担其所产生的基础设施和电网压力带来的全部成本。

这一提案正值全球数据中心资本支出激增之际,但该行业也正面临越来越多的阻力。由于当地对资源消耗、电力可靠性和电网压力的担忧,全球各地的项目频繁出现延期或取消。此外,在 OpenAI 发布此消息之前,该公司刚提交了 IPO 初稿,这标志着这家人工智能巨头在扩大基础设施需求方面迈出了重要一步。

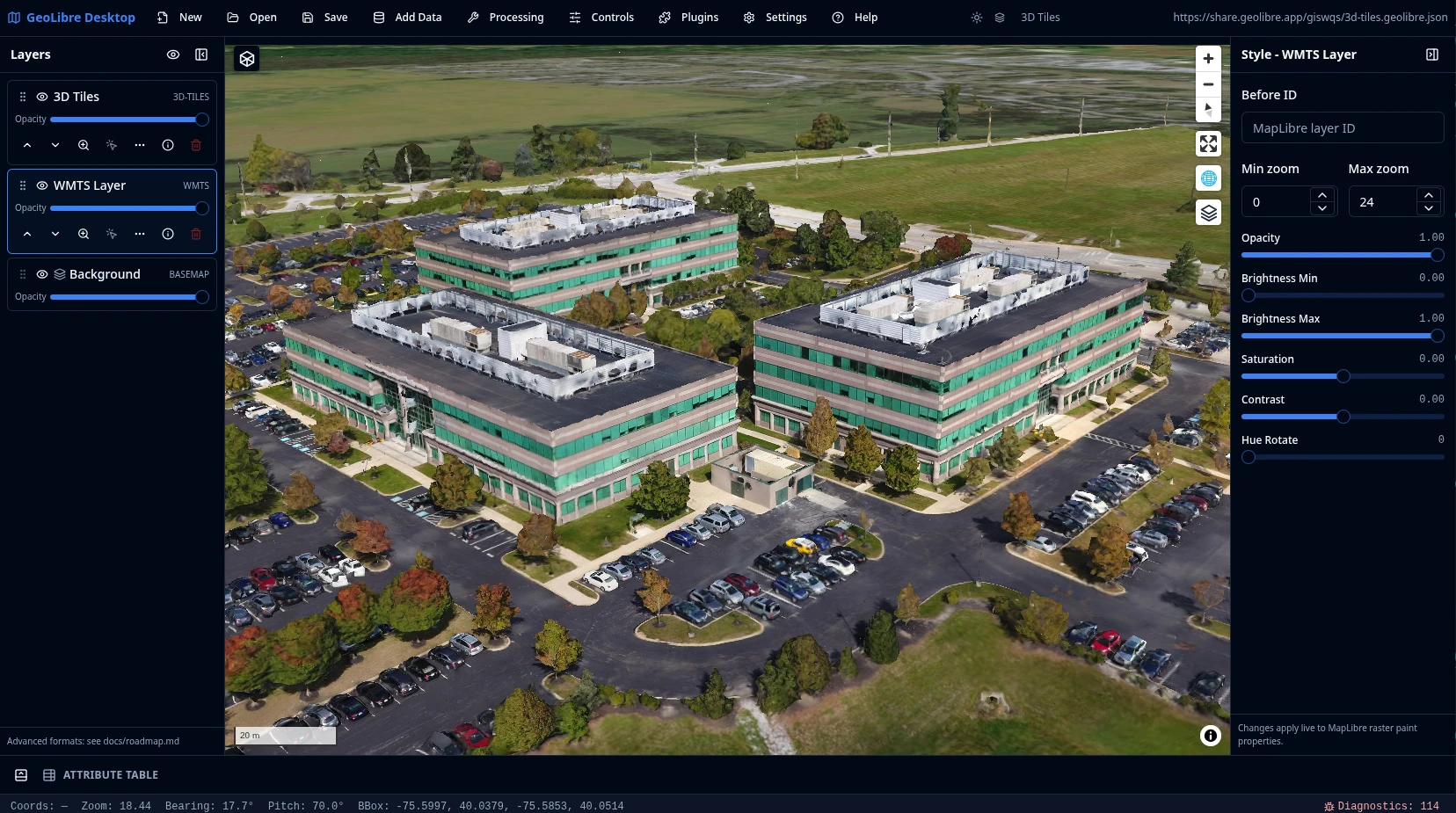

GeoLibre 是一款云原生、跨平台的 GIS 工作站,基于 Tauri、React、MapLibre 和 DuckDB-WASM 构建。它为桌面端和 Web 端提供了一个统一的操作环境,并以响应式、移动端友好的界面支持复杂的地学工作流。

主要功能包括:

* **数据处理:** 原生支持多种格式(GeoParquet、COG、PMTiles、Zarr、3D Tiles),并可与 Web 服务(WMS、WFS、STAC)无缝集成。

* **分析能力:** 集成了由 DuckDB 驱动的 SQL 工作区,以及全面的矢量(Turf.js)和栅格(rasterio/Whitebox)处理工具。

* **可扩展性:** 内置插件市场支持自定义功能扩展,同时提供与 Jupyter 兼容的 API 以实现程序化控制。

* **部署方式:** 专为隐私与高效设计,平台直接在浏览器客户端运行,并支持通过 URL 共享及嵌入功能来发布自定义地图项目。

GeoLibre 现已发布 1.0 版本,为寻求传统桌面 GIS 现代化开源替代方案的用户提供了一个稳定、高性能的解决方案。它兼具浏览器端处理的速度与原生系统工具的强大功能,让复杂的空间分析变得更易于获取与分享。

GeoLibre 是一款云原生、跨平台的 GIS 工作站,基于 Tauri、React、MapLibre 和 DuckDB-WASM 构建。它为桌面端和 Web 端提供了一个统一的操作环境,并以响应式、移动端友好的界面支持复杂的地学工作流。

主要功能包括:

* **数据处理:** 原生支持多种格式(GeoParquet、COG、PMTiles、Zarr、3D Tiles),并可与 Web 服务(WMS、WFS、STAC)无缝集成。

* **分析能力:** 集成了由 DuckDB 驱动的 SQL 工作区,以及全面的矢量(Turf.js)和栅格(rasterio/Whitebox)处理工具。

* **可扩展性:** 内置插件市场支持自定义功能扩展,同时提供与 Jupyter 兼容的 API 以实现程序化控制。

* **部署方式:** 专为隐私与高效设计,平台直接在浏览器客户端运行,并支持通过 URL 共享及嵌入功能来发布自定义地图项目。

GeoLibre 现已发布 1.0 版本,为寻求传统桌面 GIS 现代化开源替代方案的用户提供了一个稳定、高性能的解决方案。它兼具浏览器端处理的速度与原生系统工具的强大功能,让复杂的空间分析变得更易于获取与分享。

请启用 JavaScript 和 Cookie 以继续。

Meta 正在通过将大型人工智能数据中心安置在“快速部署结构”(本质上是大型防风雨帐篷)中,来加速其基础设施扩张。效仿特斯拉的工厂扩建和 xAI 的模块化能源策略,Meta 在俄亥俄州新奥尔巴尼搭建了六个 12.5 万平方英尺的帐篷,其耗时远少于传统建筑施工。 这种非传统的做法旨在加快价值数十亿美元人工智能芯片的部署速度,以助力公司在基础设施建设中抢占先机。这些帐篷由现场的模块化燃气轮机供电,这一策略与竞争对手用来规避传统电网延迟的做法如出一辙。 此举正值 Meta 面临管理巨额资本支出的巨大压力之际,其支出预计将达到 1450 亿美元。尽管华尔街对这些成本反应谨慎,但 Meta 仍专注于迅速扩大其硬件产能,尽管其在向开发者发布最新人工智能模型时面临延迟。通过使用帐篷,Meta 实际上是用传统的建筑美感换取了在这场高风险人工智能竞赛中的速度与效率。

这篇文章强调了人工智能指数级的进步速度与政治体制缓慢本质之间存在的严重错位。正如《指环王》中的树人难以跟上霍比特人的行动节奏一样,我们目前的政策机制也难以应对“强大人工智能”所带来的快速且颠覆性的影响。 作者认为,人工智能已不仅是一项消费级技术,更是一种具有国家战略意义的工具,网络安全、生物技术以及潜在的自动化替代等领域均体现了这一点。为弥合这一差距,作者提出了一个涵盖五个关键领域的积极政策框架: 1. **监管**:从单纯的透明度要求转向对前沿模型实施类似联邦航空管理局(FAA)标准的强制性安全测试。 2. **经济**:落实促进就业的激励措施与社会保障网,以应对可能出现的大规模劳动力流失。 3. **创新**:更新监管流程(如生物医学领域),以适应科学发现的加速。 4. **公民自由**:对自主系统建立严格的监督机制,以防止国家和企业滥用权力。 5. **地缘政治**:组建全球民主联盟,以确保人工智能供应链的安全并弘扬共同价值。 作者总结道,尽管形势紧迫,但现在仍存在一个非党派行动的窗口期,通过采取行动,我们既能确保人工智能带来益处,又能减轻其生存性风险。

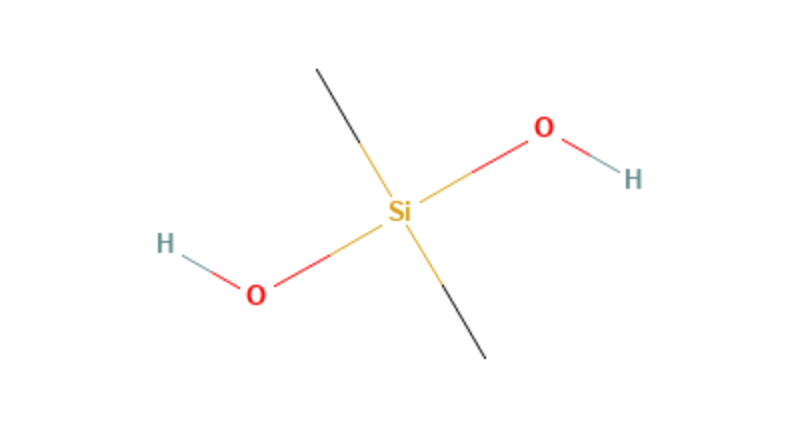

自国际空间站于2008年开始回收水资源以来,它一直面临着一个持续且“狡猾”的对手:二甲基硅二醇(DMSD)。作为硅氧烷(化妆品、乳液和润滑剂中的常见成分)的副产品,当舱内空气中的硅氧烷蒸汽受到太空辐射电离后,DMSD便会在空间站的供水系统中积聚。

DMSD之所以难以处理,是因为它具有化学惰性,能够穿透标准过滤器,并周期性地从饱和的离子交换床中洗脱出来,导致有机碳含量出现异常激增。这些激增现象损坏了关键的热交换器,并迫使任务组进行昂贵的硬件更换。美国国家航空航天局(NASA)为缓解该问题所做的尝试,凸显了空间生命支持系统复杂且相互关联的特性:活性炭空气过滤器虽然有助于捕获硅氧烷,但却无意中引发了霉菌滋生,迫使工程师们采用了混合过滤方案,这算是一种妥协而非永久性的解决方案。

DMSD事件为未来的火星任务提供了一个警示。它表明,那些看似平淡无奇的“未知隐患”如何演变成影响任务成败的关键问题,而这些问题在地球上是无法完全模拟的。这同时也证明了,在闭环系统中,最重大的风险往往隐藏在最不起眼的地方。

自国际空间站于2008年开始回收水资源以来,它一直面临着一个持续且“狡猾”的对手:二甲基硅二醇(DMSD)。作为硅氧烷(化妆品、乳液和润滑剂中的常见成分)的副产品,当舱内空气中的硅氧烷蒸汽受到太空辐射电离后,DMSD便会在空间站的供水系统中积聚。

DMSD之所以难以处理,是因为它具有化学惰性,能够穿透标准过滤器,并周期性地从饱和的离子交换床中洗脱出来,导致有机碳含量出现异常激增。这些激增现象损坏了关键的热交换器,并迫使任务组进行昂贵的硬件更换。美国国家航空航天局(NASA)为缓解该问题所做的尝试,凸显了空间生命支持系统复杂且相互关联的特性:活性炭空气过滤器虽然有助于捕获硅氧烷,但却无意中引发了霉菌滋生,迫使工程师们采用了混合过滤方案,这算是一种妥协而非永久性的解决方案。

DMSD事件为未来的火星任务提供了一个警示。它表明,那些看似平淡无奇的“未知隐患”如何演变成影响任务成败的关键问题,而这些问题在地球上是无法完全模拟的。这同时也证明了,在闭环系统中,最重大的风险往往隐藏在最不起眼的地方。

全球政府借贷正飙升至创纪录水平,仅上半年通过银团债券市场筹集的资金就达 5040 亿美元。这一激增主要源于为国防开支增加、基础设施项目、能源转型以及疫情时期到期债务的再融资提供资金的需求。

尽管债务发行规模依然庞大,但各国政府正利用投资者稳定的需求来锁定资金,以应对波动的利率和主要央行不断变化的货币政策。意大利、德国和英国等国为填补不断扩大的预算赤字,在发行债务方面表现尤为活跃。

分析人士指出,虽然部分发行是由于债务到期,但许多国家正在“预先安排”债务,以在潜在的进一步加息之前确保资金。然而,对持续借贷的依赖凸显了一种不稳定的财政模式。随着地缘政治紧张局势和人口老龄化给公共财政带来长期压力,这种不断膨胀的全球债务的可持续性引发了越来越多的担忧,因为投资者对日益增加的政府债务可能终将达到承受极限。

全球政府借贷正飙升至创纪录水平,仅上半年通过银团债券市场筹集的资金就达 5040 亿美元。这一激增主要源于为国防开支增加、基础设施项目、能源转型以及疫情时期到期债务的再融资提供资金的需求。

尽管债务发行规模依然庞大,但各国政府正利用投资者稳定的需求来锁定资金,以应对波动的利率和主要央行不断变化的货币政策。意大利、德国和英国等国为填补不断扩大的预算赤字,在发行债务方面表现尤为活跃。

分析人士指出,虽然部分发行是由于债务到期,但许多国家正在“预先安排”债务,以在潜在的进一步加息之前确保资金。然而,对持续借贷的依赖凸显了一种不稳定的财政模式。随着地缘政治紧张局势和人口老龄化给公共财政带来长期压力,这种不断膨胀的全球债务的可持续性引发了越来越多的担忧,因为投资者对日益增加的政府债务可能终将达到承受极限。

美国国土安全部(DHS)已指示移民及海关执法局(ICE)对参与美国选举投票的非公民实施严厉处罚,包括驱逐出境。国土安全部总法律顾问詹姆斯·珀西瓦尔(James Percival)援引《移民与国籍法》指出,外国人的非法投票行为稀释了美国公民的选票,损害了民主的公正性。至关重要的是,该指令确认,针对违规者启动遣返程序无需以刑事定罪为前提。

此举与特朗普总统于2025年3月签署的行政令《维护和保护美国选举公正性》相一致,该行政令旨在加强选民资格验证及选举法的执行。该指令还建立在2025年8月美国公民及移民服务局(USCIS)发布的政策更新基础之上;根据该政策,非法注册或投票的绿卡持有者将被永久禁止获得美国公民身份。总的来说,这些行动代表了联邦政府为确保只有符合资格的公民参与美国选举所采取的进一步强化措施。

美国国土安全部(DHS)已指示移民及海关执法局(ICE)对参与美国选举投票的非公民实施严厉处罚,包括驱逐出境。国土安全部总法律顾问詹姆斯·珀西瓦尔(James Percival)援引《移民与国籍法》指出,外国人的非法投票行为稀释了美国公民的选票,损害了民主的公正性。至关重要的是,该指令确认,针对违规者启动遣返程序无需以刑事定罪为前提。

此举与特朗普总统于2025年3月签署的行政令《维护和保护美国选举公正性》相一致,该行政令旨在加强选民资格验证及选举法的执行。该指令还建立在2025年8月美国公民及移民服务局(USCIS)发布的政策更新基础之上;根据该政策,非法注册或投票的绿卡持有者将被永久禁止获得美国公民身份。总的来说,这些行动代表了联邦政府为确保只有符合资格的公民参与美国选举所采取的进一步强化措施。

随着美国即将迎来建国 250 周年,作家拉里·贝伦斯(Larry Behrens)批评了加利福尼亚州、华盛顿州、伊利诺伊州、马里兰州、弗吉尼亚州和密西西比州,因为这些州定于 7 月 1 日起上调燃油税。

贝伦斯认为,这些涨价通常是由通胀挂钩公式驱动的,这使得政客无需承担公众问责即可自动增加税收。他特别将加利福尼亚州、华盛顿州和伊利诺伊州称为“贪婪轴心”,指责这些州的领导人虚伪——他们一方面将高油价归咎于石油公司,另一方面却同时增加了政府征收的成本。

文章主张,这些重税政策加上严格的环境法规和强制令,给家庭、小企业和通勤者带来了不成比例的负担。归根结底,作者将这些加税行为视为对美国革命所奠定的拒绝政府越权和过度征税原则的背叛,并暗示这些州仅仅将公民视为“移动取款机”,而非自由的个体。

随着美国即将迎来建国 250 周年,作家拉里·贝伦斯(Larry Behrens)批评了加利福尼亚州、华盛顿州、伊利诺伊州、马里兰州、弗吉尼亚州和密西西比州,因为这些州定于 7 月 1 日起上调燃油税。

贝伦斯认为,这些涨价通常是由通胀挂钩公式驱动的,这使得政客无需承担公众问责即可自动增加税收。他特别将加利福尼亚州、华盛顿州和伊利诺伊州称为“贪婪轴心”,指责这些州的领导人虚伪——他们一方面将高油价归咎于石油公司,另一方面却同时增加了政府征收的成本。

文章主张,这些重税政策加上严格的环境法规和强制令,给家庭、小企业和通勤者带来了不成比例的负担。归根结底,作者将这些加税行为视为对美国革命所奠定的拒绝政府越权和过度征税原则的背叛,并暗示这些州仅仅将公民视为“移动取款机”,而非自由的个体。

美国前总统唐纳德·特朗普最近在“真实社交”(Truth Social)平台上证实,美军一直在执行一项秘密任务,以保障商业船只安全通过霍尔木兹海峡。特朗普表示,该行动已成功促成超过200艘船只和1亿桶石油的顺利通行,有效地消除了伊朗利用该海峡作为筹码来扰乱全球能源市场的手段。

这一披露印证了摩根大通和高盛金融分析师此前的报告,他们曾指出,尽管地缘政治局势紧张,但油价却保持了出人意料的稳定。分析显示,由于许多船只通过关闭船舶自动识别系统(AIS)来避开监测,实际的航运量远高于官方数据。虽然以美国为首的行动似乎在该地区建立了一种“新的平衡”,但伊朗将如何应对这种影响力的削弱仍是一个悬而未决的问题。德黑兰现在必须决定,是容忍这些隐秘的通行,还是试图通过公开展示来重申其对这一重要海上咽喉的控制权。

美国前总统唐纳德·特朗普最近在“真实社交”(Truth Social)平台上证实,美军一直在执行一项秘密任务,以保障商业船只安全通过霍尔木兹海峡。特朗普表示,该行动已成功促成超过200艘船只和1亿桶石油的顺利通行,有效地消除了伊朗利用该海峡作为筹码来扰乱全球能源市场的手段。

这一披露印证了摩根大通和高盛金融分析师此前的报告,他们曾指出,尽管地缘政治局势紧张,但油价却保持了出人意料的稳定。分析显示,由于许多船只通过关闭船舶自动识别系统(AIS)来避开监测,实际的航运量远高于官方数据。虽然以美国为首的行动似乎在该地区建立了一种“新的平衡”,但伊朗将如何应对这种影响力的削弱仍是一个悬而未决的问题。德黑兰现在必须决定,是容忍这些隐秘的通行,还是试图通过公开展示来重申其对这一重要海上咽喉的控制权。

大型语言模型(LLMs),特别是混合专家(MoE)模型,需要复杂的并行策略才能在多个 GPU 上高效运行。标准并行化采用固定的通信模式,而 MoE 则需要“专家并行”(Expert Parallelism, EP),其数据路由是动态的,且在运行时确定。 专家并行的核心挑战在于将 Token 发送至指定的专家(“分发/Dispatch”),并将计算结果返回(“合并/Combine”)。其效率取决于服务阶段: * **高吞吐量(预填充/Prefill):** 系统在移动数据前,会执行“协调步骤”以获取精确的 Token 计数。这使得系统能够分配紧凑且内存高效的缓冲区,从而将通信开销隐藏在计算密集型的矩阵乘法之后。 * **低延迟(解码/Decode):** 为了避免网络往返带来的开销,该方法放弃了缓冲区紧凑性。它为每个源-专家对预留最坏情况下的内存缓冲区,从而实现 Token 的即时发送。这种方式通过消除协调延迟,以牺牲内存换取速度。 最终,诸如 DeepEP 等现代实现以及不断发展的 UCCL 项目,通过优化内核来处理 MoE 的动态特性,确保 Token 能够高效地在网络架构中穿梭,以匹配相应的专家并返回结果,无论系统侧重于带宽还是延迟。

该项目将 ESP32-S3 开发板转换为受“巴别图书馆”启发的无限文件系统,可通过 USB 访问。 **设置:** 1. 使用 ESP32-S3 开发板(建议使用 USB 闪存盘形状的规格)。 2. 在 VS Code 中使用 PlatformIO 插件克隆存储库及其子模块。 3. 按住“BOOT”按钮的同时将设备连接到电脑,以烧录固件。 **使用方法:** 烧录完成后,开发板将显示为 MTP 设备。若要查找特定文件,请使用提供的 `bun run file-to-path.js <path>` 命令生成路径字符串。导航至设备上的相应文件夹(以 `disk/` 为前缀),即可将文件复制到电脑。 *注意:大文件的生成需要较长时间。本项目基于 `esp32s3-tusb-mtp` 和 `espressif-tinyusb-component` 库构建。*

Extend 是一个开源 UI 工具包,专为构建现代以文档为核心的应用程序而设计。它提供了一套即用型组件,用于处理 PDF、DOCX、XLSX 和 CSV 等多种文件格式。

其主要功能包括高级文档查看器、文件上传、边界框引用以及电子签名功能。该工具包还提供了一些专用工具,例如用于配置 JSON 数据结构的 Schema Builder(模式构建器)和文档拆分工具。这些组件专为无缝集成而设计,可以轻松嵌入到面向用户的流程、AI 智能体或内部业务工具中。该项目现已在 GitHub 上开源,为开发者构建专业级文档工作流提供了灵活的框架。

Extend 是一个开源 UI 工具包,专为构建现代以文档为核心的应用程序而设计。它提供了一套即用型组件,用于处理 PDF、DOCX、XLSX 和 CSV 等多种文件格式。

其主要功能包括高级文档查看器、文件上传、边界框引用以及电子签名功能。该工具包还提供了一些专用工具,例如用于配置 JSON 数据结构的 Schema Builder(模式构建器)和文档拆分工具。这些组件专为无缝集成而设计,可以轻松嵌入到面向用户的流程、AI 智能体或内部业务工具中。该项目现已在 GitHub 上开源,为开发者构建专业级文档工作流提供了灵活的框架。

公众对美国医疗保险公司的愤怒情绪十分强烈,但这其实找错了对象。虽然保险公司常被视为医疗体系失灵的罪魁祸首,但数据表明,它们并非美国高昂医疗费用的主要推手。 保险公司的利润率通常极低,往往在 1% 到 6% 之间,远低于标普 500 指数的平均水平。即便取缔这些公司或将其转为非营利机构,所节省的开支也微不足道。此外,保险公司扮演了“替罪羊”的角色,承担了消费者因理赔被拒而产生的怒火,而实际上,是医院、制药公司和医疗设备供应商等医疗服务提供方收取了远高于其他发达国家的费用。 作者认为,进步派对保险公司的关注是一种干扰。美国医疗成本高昂的根源在于提供方本身,他们实际上是将讨债和拒绝赔付这类招致不满的工作外包给了保险公司。若要实现真正的经济可负担性,必须将重点从攻击保险中介转移到解决医疗服务的成本根源上,这可能需要通过政府主导的价格谈判和增加提供方体系内的竞争来实现。聚焦保险公司虽然能带来情绪上的宣泄,但在解决危机方面却收效甚微。

SpaceX 创纪录的 1.77 万亿美元 IPO 基于一项激进的预测:在 15 年内保持 41.5% 的年增长率,从而在 2040 年实现 3.4 万亿美元的营收。尽管摩根士丹利通过将 SpaceX 与特斯拉等历史上高增长公司进行比较来为其辩护,但这种计算忽略了规模带来的“重力”效应。 金融史表明,随着公司基数的扩大,增长率会自然衰减。SpaceX 试图从一个比特斯拉起飞阶段大 160 倍的基数上进行扩张,这实际上要求其实现比历史上任何异常值高出 44% 的增长表现。再加上 79% 的息税折旧摊销前利润(EBITDA)这一不切实际的利润率——甚至超过了沙特阿美公司——该估值看起来更像是一种人为制造的叙事,而非现实的预测。 归根结底,迫使指数基金购买仅 4% 流通股的 IPO 结构制造了人为需求,使内部人士能够在禁售期结束后抛售股票。作者认为,这并非一种长期的投资逻辑,而是一种获利的市场再平衡机制,押注的是市场愿意将埃隆·马斯克过去的成功,投射到一种史无前例、甚至在物理上可能无法实现的未来规模之上。

由于在美国得克萨斯州和新墨西哥州发现了食肉性的新世界螺旋蝇,墨西哥已暂时停止从美国进口包括牛、猪、绵羊和山羊在内的部分活体动物。

此次禁令是与美国农业部(USDA)协调采取的行动,旨在保护墨西哥的牲畜,特别是目前尚未受到该寄生虫侵害的北部各州。针对美国已确认的五起病例,美国农业部已建立了一个20公里的隔离区,加强了监测,并正在释放不育蝇以遏制虫害。两国官员正共同努力,以确定何时能够安全恢复贸易。

新世界螺旋蝇是一种危险的寄生虫,会感染牲畜、野生动物,偶尔也会感染人类的活体组织,如果不加以治疗,往往会致命。虽然这种害虫主要通过不育蝇项目进行控制,但其在美国的再次出现已引发了积极的遏制行动。美国农业部和墨西哥当局也在加强对进入墨西哥的宠物犬的健康检查,以防止进一步扩散。

由于在美国得克萨斯州和新墨西哥州发现了食肉性的新世界螺旋蝇,墨西哥已暂时停止从美国进口包括牛、猪、绵羊和山羊在内的部分活体动物。

此次禁令是与美国农业部(USDA)协调采取的行动,旨在保护墨西哥的牲畜,特别是目前尚未受到该寄生虫侵害的北部各州。针对美国已确认的五起病例,美国农业部已建立了一个20公里的隔离区,加强了监测,并正在释放不育蝇以遏制虫害。两国官员正共同努力,以确定何时能够安全恢复贸易。

新世界螺旋蝇是一种危险的寄生虫,会感染牲畜、野生动物,偶尔也会感染人类的活体组织,如果不加以治疗,往往会致命。虽然这种害虫主要通过不育蝇项目进行控制,但其在美国的再次出现已引发了积极的遏制行动。美国农业部和墨西哥当局也在加强对进入墨西哥的宠物犬的健康检查,以防止进一步扩散。

机构共识正在从“代币最大化”(以原始代币数量衡量AI成功)转向更严格的“单位任务成本”导向。阿波罗全球管理的约翰·齐托(John Zito)及高盛分析师认为,尽管AI账单呈爆炸式增长,但“智能”单位的实际成本正在急剧下降。

当前的预算危机源于企业在琐碎任务上部署昂贵的前沿模型(即“法式吐司”问题),导致了使用上限和成本控制准则的普遍实施。瑞银报告显示,企业并未放弃AI,而是通过将简单工作负载分配给更廉价、本地化或开源的模型,同时将高成本的前沿模型保留用于高投资回报率任务,以此实现优化。

这种代币数量与价值的脱钩,为AI行业带来了迫在眉睫的挑战。即使计算需求总量持续增长,向商品化推理和模型降级的转变,仍威胁着基础设施提供商目前享有的高额利润。随着市场从关注代币总量指标转向价值经济,我们正进入一个不可避免的重定价阶段,即原始代币消耗的“噪音”正被更理性的资本效率分析所取代。

机构共识正在从“代币最大化”(以原始代币数量衡量AI成功)转向更严格的“单位任务成本”导向。阿波罗全球管理的约翰·齐托(John Zito)及高盛分析师认为,尽管AI账单呈爆炸式增长,但“智能”单位的实际成本正在急剧下降。

当前的预算危机源于企业在琐碎任务上部署昂贵的前沿模型(即“法式吐司”问题),导致了使用上限和成本控制准则的普遍实施。瑞银报告显示,企业并未放弃AI,而是通过将简单工作负载分配给更廉价、本地化或开源的模型,同时将高成本的前沿模型保留用于高投资回报率任务,以此实现优化。

这种代币数量与价值的脱钩,为AI行业带来了迫在眉睫的挑战。即使计算需求总量持续增长,向商品化推理和模型降级的转变,仍威胁着基础设施提供商目前享有的高额利润。随着市场从关注代币总量指标转向价值经济,我们正进入一个不可避免的重定价阶段,即原始代币消耗的“噪音”正被更理性的资本效率分析所取代。

**UDP 快速传输协议安全版 (USTPS)** 是一款处于测试阶段的传输协议,旨在实现基于 UDP 的高性能、速度优先的数据传输。与 TCP 不同,USTPS 不执行拥塞控制,优先考虑低延迟传输,而非网络限速机制。 **主要技术特性:** * **安全性:** 要求使用 AEAD 加密(ChaCha20-Poly1305 或 AES-GCM),并在每次会话中使用临时 X25519 密钥交换,同时采用“首次使用时信任”(TOFU) 模型进行服务器身份验证。 * **无队头阻塞的可靠性:** USTPS 通过选择性重传和独立的确认应答 (ACK) 确保可靠传输。关键在于,它在传输层是不排序的;丢失的数据包不会阻塞后续数据的交付。 * **元数据驱动排序:** 数据包同时包含用于可靠性的传输序列号和用于逻辑排序的 `stream_pos`。这使得应用程序能够重建数据流,而不会遭受 TCP 式的队头阻塞。 * **实现方式:** USTPS 作为内部传输数据包 (UST1) 的安全封装 (USS1)。它旨在实现高度灵活,提供用于测试抗丢包能力的工具,并作为流媒体和 USSH 等终端协议的基础设施。 USTPS 非常适合需要快速、安全且可靠,并能原生处理乱序交付的通信应用。

请启用 JavaScript 和 Cookie 以继续。

**摘要:Claude Desktop 内存占用漏洞**

Windows 版 Claude Desktop 应用程序存在严重的资源占用漏洞,即在启动时会无条件启动一个 Hyper-V 虚拟机 (Vmmem),占用约 1.8 GB 内存。即便用户仅进行简单的聊天操作,且无需使用 Agent 或“Cowork”功能时,该虚拟机依然会运行。

**主要问题:**

* **资源效率低下:** 在 16 GB 内存的系统中,该开销会占用超过 11% 的可用内存,导致整个系统运行缓慢。

* **持续运行的虚拟机:** 即使在清理了数千个陈旧的会话文件后,该虚拟机仍会通过 `vmcompute` 服务自动启动。

* **初始化错误:** 日志显示,由于应用程序尝试初始化虚拟基础架构,导致了重复的 JSON 文档错误 (`0xC037010D`)。

**请求修复:**

* **按需初始化:** 应仅在用户明确触发 Agent 或 Cowork 会话时,才启动虚拟机基础架构。

* **清理机制:** 实现陈旧会话文件的自动删除,以防止目录臃肿。

* **平稳降级:** 应用程序应在无需活动虚拟化服务的情况下,支持聊天功能。

**当前临时解决方案:** 用户必须彻底禁用 `VirtualMachinePlatform` 功能,或者在每次启动应用程序后手动终止 `vmwp` 和 `vmcompute` 进程。

**摘要:Claude Desktop 内存占用漏洞**

Windows 版 Claude Desktop 应用程序存在严重的资源占用漏洞,即在启动时会无条件启动一个 Hyper-V 虚拟机 (Vmmem),占用约 1.8 GB 内存。即便用户仅进行简单的聊天操作,且无需使用 Agent 或“Cowork”功能时,该虚拟机依然会运行。

**主要问题:**

* **资源效率低下:** 在 16 GB 内存的系统中,该开销会占用超过 11% 的可用内存,导致整个系统运行缓慢。

* **持续运行的虚拟机:** 即使在清理了数千个陈旧的会话文件后,该虚拟机仍会通过 `vmcompute` 服务自动启动。

* **初始化错误:** 日志显示,由于应用程序尝试初始化虚拟基础架构,导致了重复的 JSON 文档错误 (`0xC037010D`)。

**请求修复:**

* **按需初始化:** 应仅在用户明确触发 Agent 或 Cowork 会话时,才启动虚拟机基础架构。

* **清理机制:** 实现陈旧会话文件的自动删除,以防止目录臃肿。

* **平稳降级:** 应用程序应在无需活动虚拟化服务的情况下,支持聊天功能。

**当前临时解决方案:** 用户必须彻底禁用 `VirtualMachinePlatform` 功能,或者在每次启动应用程序后手动终止 `vmwp` 和 `vmcompute` 进程。

HelixDB 是一个统一的数据库平台,旨在通过消除对独立关系型、向量、图和应用数据库的需求,来简化 AI 应用开发。它原生集成了这些模型,为 AI 智能体提供对企业数据的联合访问,以实现记忆和逻辑功能。 **主要特性:** * **统一模型:** 主要采用图 + 向量方法,同时支持键值(KV)、文档和关系型数据。 * **快速开发:** `helix chef` 命令行工具支持交互式的一次性引导流程。配合编程智能体(如 Claude Code)使用时,可仅凭单条文本提示词生成全栈应用。 * **开发者友好:** 查询使用 Rust 或 TypeScript DSL 编写,支持动态请求,无需复杂的构建或部署步骤。 * **灵活部署:** 开发者可以运行本地实例进行快速原型设计,或过渡到 HelixDB Cloud 以获得支持 ACID 事务、高可用、自动扩展及集成向量/全文搜索的生产级托管服务。 通过整合存储层,HelixDB 使开发者能够通过单一、一致的接口来构建、测试并扩展 AI 驱动的应用程序。

这段内容为 PDF 文件的原始二进制代码及乱码数据,无法翻译为中文。

继昨天表现平平的3年期国债拍卖之后,美国财政部刚刚完成了一场出色的10年期国债(CUSIP QQ7)重启发行。此次发行的390亿美元9年11个月期债券中标收益率为4.538%,高于上月的4.468%,但比发行时的预发行利率(When Issued)4.539%低了0.1个基点。这是该期限国债连续四次拍卖表现不佳后的首次“截标”(即中标利率低于预发行利率)。

投标倍数从2.402升至2.565,远高于六次拍卖平均水平,并创下9月25日以来的新高。

内部数据表现亮眼:间接投标者比例从63.95%大幅跃升至78.21%,位居历史前五高位;我们上一次看到如此强劲的海外需求还是在9月25日。

此外,直接投标者比例降至仅9.5%,为1月以来的最低水平;交易商获配比例为12.32%,远低于近期21.39%的平均水平。

总体而言,这是一场非常出色的10年期国债拍卖,较昨天(表现尚可的)3年期拍卖有显著改善。至少从债券市场的反应来看,这表明今日发布的CPI数据无需担忧。

继昨天表现平平的3年期国债拍卖之后,美国财政部刚刚完成了一场出色的10年期国债(CUSIP QQ7)重启发行。此次发行的390亿美元9年11个月期债券中标收益率为4.538%,高于上月的4.468%,但比发行时的预发行利率(When Issued)4.539%低了0.1个基点。这是该期限国债连续四次拍卖表现不佳后的首次“截标”(即中标利率低于预发行利率)。

投标倍数从2.402升至2.565,远高于六次拍卖平均水平,并创下9月25日以来的新高。

内部数据表现亮眼:间接投标者比例从63.95%大幅跃升至78.21%,位居历史前五高位;我们上一次看到如此强劲的海外需求还是在9月25日。

此外,直接投标者比例降至仅9.5%,为1月以来的最低水平;交易商获配比例为12.32%,远低于近期21.39%的平均水平。

总体而言,这是一场非常出色的10年期国债拍卖,较昨天(表现尚可的)3年期拍卖有显著改善。至少从债券市场的反应来看,这表明今日发布的CPI数据无需担忧。

尽管地缘政治局势紧张,流经霍尔木兹海峡的石油运输量仍在增加,这有助于稳定全球能源价格并防止供应危机。报告显示,中东产油国正通过使用政府控制的油轮成功通过这一咽喉要道;这些油轮往往在夜幕掩护下关闭应答器航行,以避免被发现。

卫星图像证实了该地区运输活动的增加,包括此前停滞的阿曼海岸外船对船转运业务。虽然目前的运输量仍低于战前水平,但在美国支持和替代管道基础设施的助力下,油轮的稳定运输已有效地削弱了伊朗对全球能源市场的掌控力。

包括高盛在内的市场分析师认为,正是这些隐蔽的运输行动解释了为何油价较冲突高峰期下跌了近30%。尽管局势进一步升级的风险依然存在,但市场目前的表现显示其有能力绕过封锁。因此,石油的“地缘政治风险溢价”已经降低,这表明全球市场比此前预期的更具韧性,能够抵御干扰。

尽管地缘政治局势紧张,流经霍尔木兹海峡的石油运输量仍在增加,这有助于稳定全球能源价格并防止供应危机。报告显示,中东产油国正通过使用政府控制的油轮成功通过这一咽喉要道;这些油轮往往在夜幕掩护下关闭应答器航行,以避免被发现。

卫星图像证实了该地区运输活动的增加,包括此前停滞的阿曼海岸外船对船转运业务。虽然目前的运输量仍低于战前水平,但在美国支持和替代管道基础设施的助力下,油轮的稳定运输已有效地削弱了伊朗对全球能源市场的掌控力。

包括高盛在内的市场分析师认为,正是这些隐蔽的运输行动解释了为何油价较冲突高峰期下跌了近30%。尽管局势进一步升级的风险依然存在,但市场目前的表现显示其有能力绕过封锁。因此,石油的“地缘政治风险溢价”已经降低,这表明全球市场比此前预期的更具韧性,能够抵御干扰。

请提供您需要翻译的内容。