## SQLite-Graph:SQLite 的图数据库扩展(Alpha)

SQLite-Graph 是一个处于 Alpha 阶段的 SQLite 扩展,它带来了图数据库功能,并提供**完整的、基本的 Cypher 查询支持**。作为 AgentFlare AI 生态系统的一部分开发,它允许利用 SQLite 的可靠性和 Cypher 的表达力来构建复杂的图应用程序。

**主要特性:**核心图操作(通过 SQL 创建、读取、更新、删除节点/边)、端到端 Cypher 执行(包括 `CREATE`、`MATCH`、`WHERE` 和 `RETURN`)、图虚拟表以及基本的图算法(连通性、密度、中心性)。它拥有令人印象深刻的性能——**30 万+ 节点/秒和 39 万+ 边/秒**——并包含 **Python 3.6+ 绑定**。

**目前,由于其 Alpha 状态和潜在的 API 变更,不建议将此扩展用于生产环境**。开发重点是实现完全的 openCypher 兼容性、高级查询功能和性能优化,路线图一直延伸到 2027 年。

**安装**涉及下载预构建的二进制文件或从源代码构建。基本用法示例演示了 Cypher 查询和基于 SQL 函数的图操作。

每日HackerNews RSS

这篇文章解释了迷人的**抖动**过程,这是一种用于创造*看起来*比实际可用的颜色更多的技术的手段。具体来说,它着重介绍了抖动如何使用只有黑白像素来模拟灰度阴影。 与简单地将像素映射到最接近的可用颜色(导致生硬的过渡)不同,抖动策略性地以图案分布黑白像素。更密集的黑色浓度产生更深的阴影,而更密集的白色浓度产生更浅的阴影。 一种方法,**有序抖动**,利用**阈值图**——一个将每个像素的亮度与设定的值进行比较的网格。如果像素比阈值亮,它就变成白色;否则,变成黑色。在整个图像上重复此过程,通过不同的像素密度来重现阴影。 本质上,抖动不是*添加*效果,而是巧妙地*移除*颜色信息,同时保留整体视觉外观。这是三部分系列文章的第一部分,未来将计划探索不同的抖动算法,例如阈值图创建和误差扩散。

Extropic 正在开发革命性的热力学计算硬件,旨在比传统 GPU 更加节能,尤其是在 AI 工作负载方面。他们的核心创新——热力学采样单元 (TSU) 本质上是概率性的,与概率 AI 算法完美契合。

为了方便开发,Extropic 提供 XTR-0 平台,用于低延迟的芯片到处理器的通信,以及 THRML,一个用于算法创建和 TSU 模拟的开源 Python 库。

Extropic 通过多次媒体露面(Wired、TED AI、Lex Fridman & Garry Tan 的播客)和详细介绍其技术的出版物而备受关注。他们正在积极扩大团队,寻找工程师和科学家来推进这种新的计算范式。最终,Extropic 旨在以其节能的 AI 处理方法颠覆当前的数据中心格局。

Extropic 正在开发革命性的热力学计算硬件,旨在比传统 GPU 更加节能,尤其是在 AI 工作负载方面。他们的核心创新——热力学采样单元 (TSU) 本质上是概率性的,与概率 AI 算法完美契合。

为了方便开发,Extropic 提供 XTR-0 平台,用于低延迟的芯片到处理器的通信,以及 THRML,一个用于算法创建和 TSU 模拟的开源 Python 库。

Extropic 通过多次媒体露面(Wired、TED AI、Lex Fridman & Garry Tan 的播客)和详细介绍其技术的出版物而备受关注。他们正在积极扩大团队,寻找工程师和科学家来推进这种新的计算范式。最终,Extropic 旨在以其节能的 AI 处理方法颠覆当前的数据中心格局。

## 使用 `uv` 简化 Python 开发 对 Python 环境管理的复杂性感到沮丧吗?Astral 的全新、免费且开源工具 `uv` 旨在彻底改变这一过程。`uv` 使用 Rust 构建,具有速度快和跨平台兼容性,可以处理 Python 版本安装、包管理、虚拟环境和依赖关系解析——通常比现有工具更快。 安装简单,大多数操作系统只需一行命令即可。`uv` 无缝利用 `pyproject.toml` 文件来定义项目依赖项和 Python 版本。关键命令包括 `uv init` 用于启动新项目,`uv sync` 用于安装依赖项并创建锁定环境(确保团队之间的一致性),以及 `uv run` 用于在正确环境中执行命令,无需激活。 使用 `uv add` 可以简化添加依赖项的操作,并且可以为项目稳定性固定特定的 Python 版本。对于快速的一次性任务,`uvx` 提供了一张“赦免卡”,在临时环境中运行工具。 `uv` 已经证明对于团队来说非常有价值,例如 The Astrosky Ecosystem 的开发者,确保在各种系统上安装一致的 Python 版本,并简化 CI/CD 管道。它是 Python 开发领域的重要一步,提供更简单、更快、更可靠的体验。 了解更多信息,请访问 [uv 文档](https://uv.readthedocs.io/en/latest/)。

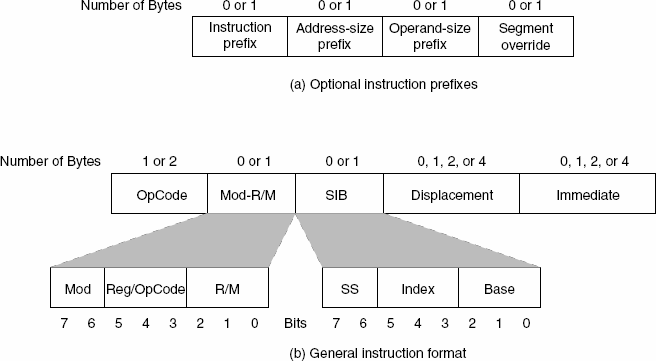

## x86 指令编码概要

本文概述了 x86 指令编码的基础知识。x86 指令使用一个或两个字节的 opcode,第二个字节用于 opcode *扩展*(前缀 `0Fh`)。这些 opcode 编码了操作、操作数及其大小。

一个关键组成部分是 **MOD-REG-R/M 字节**,它指定操作数寻址模式——数据是在寄存器中还是内存中,以及任何位移值。**MOD** 字段定义寻址模式,**REG** 标识一个寄存器,**R/M** 指定第二个操作数或单操作数指令的唯一操作数。opcode 中的方向位 (`d`) 决定了源/目的地的角色。

操作数大小由 opcode 中的一位 (`s`) 指示,使用前缀字节 (`66h`) 来指定 32 位环境中的 16 位操作数。还存在其他前缀,用于重复字符串 (`REP`, `REPE`, `REPNE`)、段覆盖以及操作数/地址大小修改。

Intel 提供了针对常用指令的替代、更短的编码,使用累加器寄存器 (AL, AX, EAX) 来优化代码大小。理解这些编码需要查阅诸如 Intel 架构软件开发人员手册之类的资源,特别是第 2 卷(指令集参考),其中详细介绍了每个指令的机器代码表示。x86 架构代表了功能、效率和向后兼容性之间复杂的平衡。

## x86 指令编码概要

本文概述了 x86 指令编码的基础知识。x86 指令使用一个或两个字节的 opcode,第二个字节用于 opcode *扩展*(前缀 `0Fh`)。这些 opcode 编码了操作、操作数及其大小。

一个关键组成部分是 **MOD-REG-R/M 字节**,它指定操作数寻址模式——数据是在寄存器中还是内存中,以及任何位移值。**MOD** 字段定义寻址模式,**REG** 标识一个寄存器,**R/M** 指定第二个操作数或单操作数指令的唯一操作数。opcode 中的方向位 (`d`) 决定了源/目的地的角色。

操作数大小由 opcode 中的一位 (`s`) 指示,使用前缀字节 (`66h`) 来指定 32 位环境中的 16 位操作数。还存在其他前缀,用于重复字符串 (`REP`, `REPE`, `REPNE`)、段覆盖以及操作数/地址大小修改。

Intel 提供了针对常用指令的替代、更短的编码,使用累加器寄存器 (AL, AX, EAX) 来优化代码大小。理解这些编码需要查阅诸如 Intel 架构软件开发人员手册之类的资源,特别是第 2 卷(指令集参考),其中详细介绍了每个指令的机器代码表示。x86 架构代表了功能、效率和向后兼容性之间复杂的平衡。

请启用 JavaScript 并禁用任何广告拦截器。

## 一百年的时钟调整:英国夏令时历史 自1925年夏令时法案以来,英国已经与夏令时的复杂性斗争了100年。这始于威廉·威莱特在1907年提出的提前时钟的提议,最初被议会拒绝,但在第一次世界大战期间于1916年采用。随后的几十年里,出现了一系列混乱的调整——日期每年变化,受到战争需求(如二战期间的“双夏令时”)和燃料短缺(导致1947年四次时钟调整!)的影响。 1925年规则得到简化,但随着调查和试验,规则不断演变,包括在20世纪60年代末对永久使用GMT+1(英国标准时间)进行为期三年的试验,最终被放弃。 1980年代和90年代的欧盟指令带来了进一步的协调,最终确定了在三月最后一个星期日提前时钟,并在十月最后一个星期日恢复原时制——这一制度已经实施了30年。尽管英国脱欧为改变提供了机会,但这一问题的分裂性质以及与爱尔兰可能出现的复杂情况意味着“最后一个星期日”的规则可能仍将保留,在经历了百年的“麻烦和调整”之后,提供一定程度的简单性。

关于 新闻 版权 联系我们 创作者 广告 开发者 条款 隐私政策和安全 YouTube 工作原理 测试新功能 © 2025 Google LLC

请启用 JavaScript 并禁用任何广告拦截器。

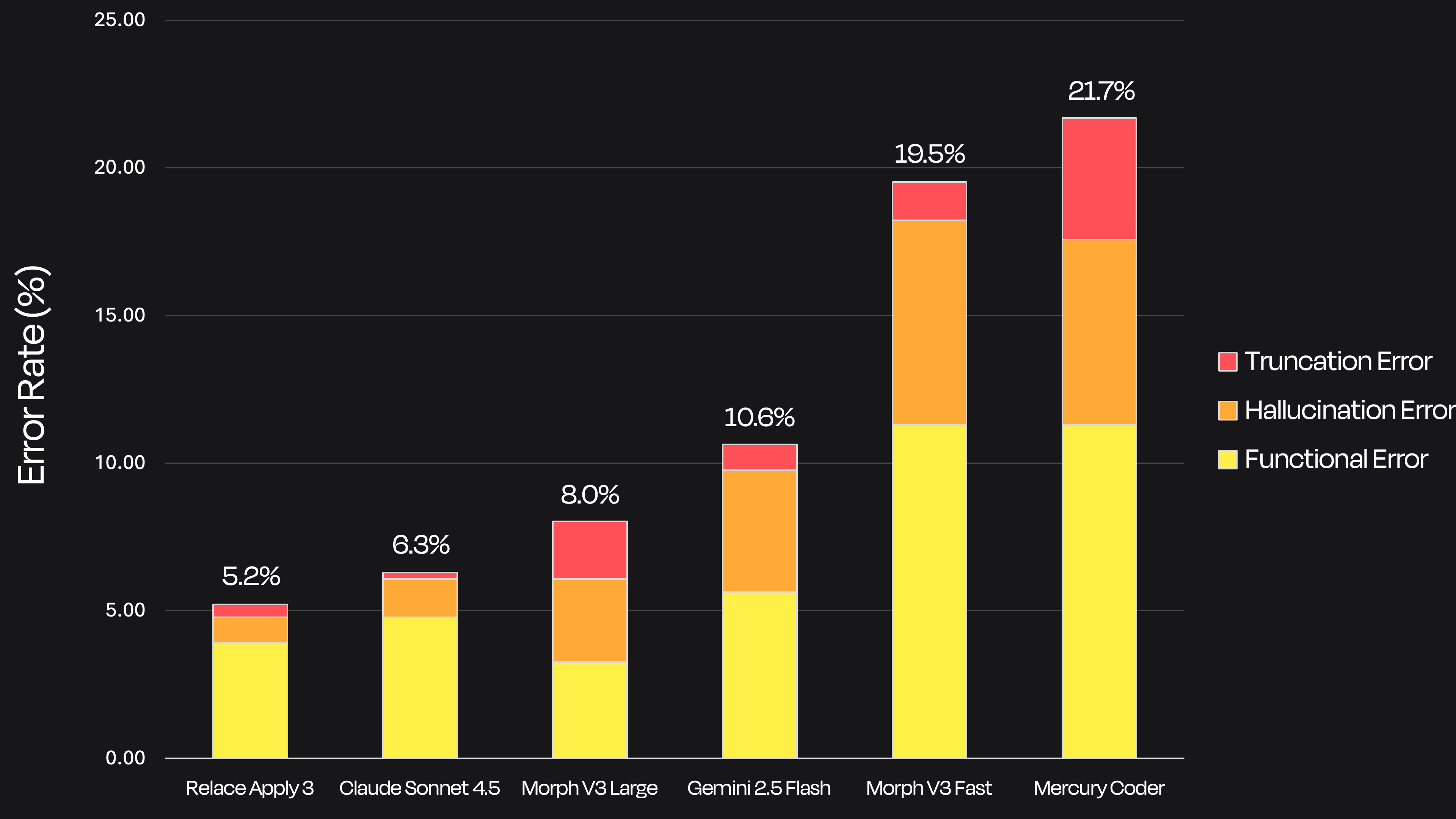

## Relace Apply 3:开源一款快速且准确的代码合并模型

在发布最初的Fast Apply模型一年后,Relace正在开源**Relace Apply 3**背后的经验,该模型在代码合并方面实现了**每秒10k+ tokens**的性能,并具有最先进的准确性。解决的核心问题是使用大型语言模型重新生成整个代码库以进行小幅修改效率低下——这是一个代价高昂且缓慢的过程。

Relace的解决方案采用“diff & apply”方法:前沿模型生成最小的代码更改(diff),而一个更小、更专业的“apply模型”有效地合并这些更改。他们发现高质量、多样化的数据集(约14.5万个示例)至关重要,优先考虑质量而非单纯的大小。该数据集是通过与prompt-to-app公司合作来捕捉真实世界的合并场景创建的,然后使用LLM作为裁判进行可扩展的质量控制。

训练利用了开源模型上的**LoRA**(参数量为3-8B)和**FP8量化**以提高速度。**推测解码**进一步提升了推理速度,利用了代码合并的可预测性。Relace Apply 3在准确性方面超越了之前的模型,尤其是在复杂的编辑方面,并支持256k上下文窗口。这项工作展示了专门的小模型在目标数据上进行训练的强大力量,Relace正在将这种策略扩展到其他编码任务。他们正在积极招聘以继续这项研究。

## Relace Apply 3:开源一款快速且准确的代码合并模型

在发布最初的Fast Apply模型一年后,Relace正在开源**Relace Apply 3**背后的经验,该模型在代码合并方面实现了**每秒10k+ tokens**的性能,并具有最先进的准确性。解决的核心问题是使用大型语言模型重新生成整个代码库以进行小幅修改效率低下——这是一个代价高昂且缓慢的过程。

Relace的解决方案采用“diff & apply”方法:前沿模型生成最小的代码更改(diff),而一个更小、更专业的“apply模型”有效地合并这些更改。他们发现高质量、多样化的数据集(约14.5万个示例)至关重要,优先考虑质量而非单纯的大小。该数据集是通过与prompt-to-app公司合作来捕捉真实世界的合并场景创建的,然后使用LLM作为裁判进行可扩展的质量控制。

训练利用了开源模型上的**LoRA**(参数量为3-8B)和**FP8量化**以提高速度。**推测解码**进一步提升了推理速度,利用了代码合并的可预测性。Relace Apply 3在准确性方面超越了之前的模型,尤其是在复杂的编辑方面,并支持256k上下文窗口。这项工作展示了专门的小模型在目标数据上进行训练的强大力量,Relace正在将这种策略扩展到其他编码任务。他们正在积极招聘以继续这项研究。