/uploads/tedium_affinity.png) Canva正在挑战Adobe在设计软件市场长达数十年的统治地位,通过免费提供专业级的Affinity软件来实现。 过去,设计软件价格昂贵,对许多人来说是进入门槛。 尽管Adobe的订阅用户(3700万)仍然多于Canva的付费用户(2400万),但Canva的目标市场不同:即“普通用户”——那些需要简单设计工具来完成社交媒体帖子和演示文稿等任务的日常用户。

Canva的策略基于这样的理念,即这类休闲用户的数量是专业设计师的六倍。 通过免费提供功能强大的Affinity软件,他们旨在消除专业人士对Adobe的偏好,同时吸引更广泛的用户。 Affinity包含人工智能功能,即使对于不喜欢使用的人来说需要付费,也能满足投资者的期望。

计划是让专业人士使用Affinity进行细致的“创作”,然后无缝地将素材上传到Canva进行更广泛的团队“扩展”。 这种方法将Canva定位为Adobe的补充工具,而不是替代品,有可能达到与Microsoft 365相当的订阅用户数量。 最终,Canva押注于可访问性和数量,以颠覆设计软件格局。

Canva正在挑战Adobe在设计软件市场长达数十年的统治地位,通过免费提供专业级的Affinity软件来实现。 过去,设计软件价格昂贵,对许多人来说是进入门槛。 尽管Adobe的订阅用户(3700万)仍然多于Canva的付费用户(2400万),但Canva的目标市场不同:即“普通用户”——那些需要简单设计工具来完成社交媒体帖子和演示文稿等任务的日常用户。

Canva的策略基于这样的理念,即这类休闲用户的数量是专业设计师的六倍。 通过免费提供功能强大的Affinity软件,他们旨在消除专业人士对Adobe的偏好,同时吸引更广泛的用户。 Affinity包含人工智能功能,即使对于不喜欢使用的人来说需要付费,也能满足投资者的期望。

计划是让专业人士使用Affinity进行细致的“创作”,然后无缝地将素材上传到Canva进行更广泛的团队“扩展”。 这种方法将Canva定位为Adobe的补充工具,而不是替代品,有可能达到与Microsoft 365相当的订阅用户数量。 最终,Canva押注于可访问性和数量,以颠覆设计软件格局。

每日HackerNews RSS

科幻作品中经常将飞船控制描绘成类似于驾驶,但轨道力学远比这复杂。与飞机不同,在轨道上进行的机动并不总是产生预期的效果,因为其中涉及独特的物理原理。 一个关键概念是**向心加速度**:即使在恒定*速度*下,以圆形运动的物体也在不断*加速*,因为它的*方向*在不断变化。这种加速度指向圆心,其强度取决于物体的速度和轨道半径。 理解这种“指向中心”的加速度对于掌握航天器运动方式至关重要。文章承诺将通过模型和模拟进一步探讨这些概念,特别是关注轨道机动(如对接)的挑战——展示太空旅行与地球上所经历的任何事物有多么不同。

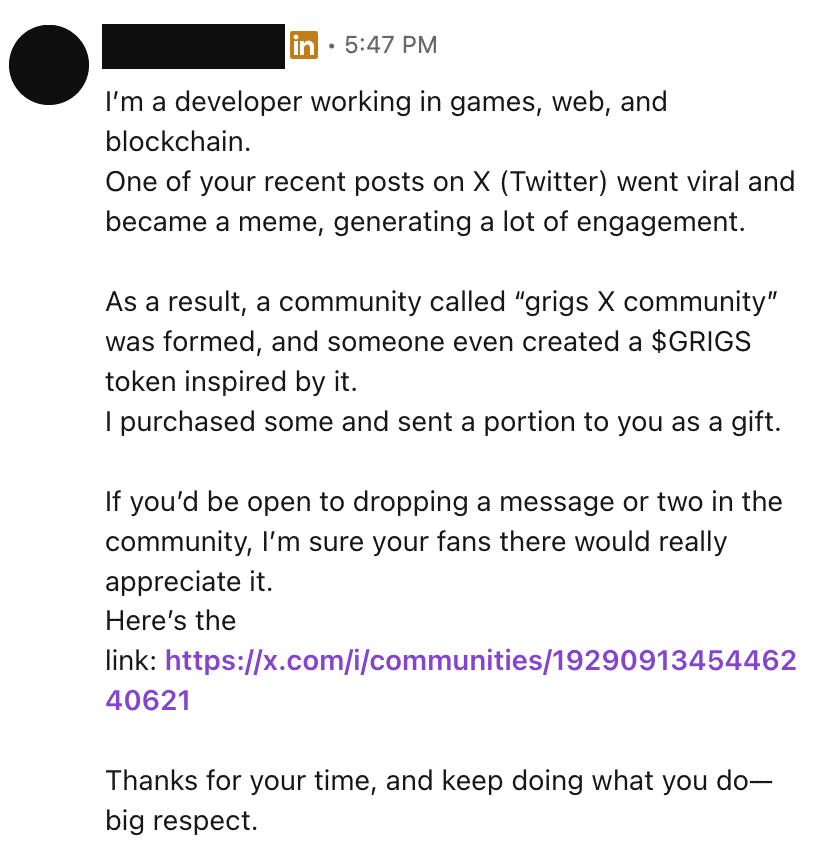

一个男子发现自己2007年的一条推文——已知Twitter上“grok”一词的首次使用——被做成了一种名为$grigs的迷因币。围绕这种货币形成了一个社区,他们希望以“grok”命名其AI聊天机器人的埃隆·马斯克能够注意到并提升其价值。该社区甚至创作了包含作者和马斯克两人的AI图像。

最初感到困惑的作者通过《行星金钱》播客了解了迷因币,意识到该社区试图利用他早期使用“grok”一词来吸引马斯克的注意。他甚至被提供代币来推广这种货币,但由于担心其诈骗性质,他寻求了建议。

受到《行星金钱》另一集关于类似情况的启发,他最终公开声明与该货币无关,并澄清自己没有持有任何代币。虽然他希望自己的声明能劝退投资,但该货币的命运可能已被马斯克和特朗普之间随后在Twitter上引发的争端所决定。他最后推荐了罗伯特·海因莱因的小说《异乡异客》,该词的起源就在其中。

一个男子发现自己2007年的一条推文——已知Twitter上“grok”一词的首次使用——被做成了一种名为$grigs的迷因币。围绕这种货币形成了一个社区,他们希望以“grok”命名其AI聊天机器人的埃隆·马斯克能够注意到并提升其价值。该社区甚至创作了包含作者和马斯克两人的AI图像。

最初感到困惑的作者通过《行星金钱》播客了解了迷因币,意识到该社区试图利用他早期使用“grok”一词来吸引马斯克的注意。他甚至被提供代币来推广这种货币,但由于担心其诈骗性质,他寻求了建议。

受到《行星金钱》另一集关于类似情况的启发,他最终公开声明与该货币无关,并澄清自己没有持有任何代币。虽然他希望自己的声明能劝退投资,但该货币的命运可能已被马斯克和特朗普之间随后在Twitter上引发的争端所决定。他最后推荐了罗伯特·海因莱因的小说《异乡异客》,该词的起源就在其中。

## Claude.ai 错误更新 – 及时了解 您现在可以通过电子邮件和/或短信接收影响 Claude.ai 的问题更新。此服务将通知您任何“严重错误”——即影响 Claude 性能的事件。 **工作原理:** * **电子邮件:** 在发布事件更新时收到通知。 * **短信:** 当 Claude 出现新问题*或*现有问题解决时,立即收到短信提醒。 **短信覆盖范围:** 短信更新适用于非常广泛的国家/地区列表(包括美国、加拿大、英国、欧洲大部分地区、亚洲、非洲和南美洲——完整列表请参阅原始来源)。您需要使用 OTP 验证您的手机号码才能激活短信提醒。 要订阅,只需提供您的电子邮件和/或手机号码即可。如果您愿意,可以选择仅通过电子邮件接收更新。

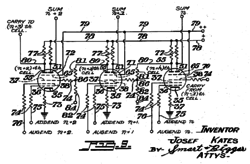

## Bertie the Brain:早期电子游戏历史的一步

“Bertie the Brain”由Josef Kates博士于1950年为加拿大国家展览会建造,被认为是早期电子游戏的一个例子。这台四米高的计算机允许参观者与人工智能对战井字游戏。玩家通过键盘输入棋步,游戏在一个由照明灯组成的网格上显示。Bertie甚至具有可调节的难度级别,喜剧演员丹尼·凯伊曾著名地与这台机器对战(并输了)。

Kates设计Bertie是为了展示他的“additron”管,一种微型真空管,但这项技术很快被晶体管超越。尽管在展览会上取得了成功,Bertie还是被拆解并 largely 被遗忘,因为专利问题阻碍了additron管的更广泛应用。

虽然一些人争论Bertie是否完全符合“电子游戏”的定义,因为它使用灯而不是屏幕,但它是一款具有视觉显示的开创性互动电脑游戏——出现在第一个电子娱乐设备问世仅仅三年后。Bertie仍然是游戏历史上的一个重要里程碑,尽管常常被忽视。

## Bertie the Brain:早期电子游戏历史的一步

“Bertie the Brain”由Josef Kates博士于1950年为加拿大国家展览会建造,被认为是早期电子游戏的一个例子。这台四米高的计算机允许参观者与人工智能对战井字游戏。玩家通过键盘输入棋步,游戏在一个由照明灯组成的网格上显示。Bertie甚至具有可调节的难度级别,喜剧演员丹尼·凯伊曾著名地与这台机器对战(并输了)。

Kates设计Bertie是为了展示他的“additron”管,一种微型真空管,但这项技术很快被晶体管超越。尽管在展览会上取得了成功,Bertie还是被拆解并 largely 被遗忘,因为专利问题阻碍了additron管的更广泛应用。

虽然一些人争论Bertie是否完全符合“电子游戏”的定义,因为它使用灯而不是屏幕,但它是一款具有视觉显示的开创性互动电脑游戏——出现在第一个电子娱乐设备问世仅仅三年后。Bertie仍然是游戏历史上的一个重要里程碑,尽管常常被忽视。

启用 JavaScript 和 Cookie 以继续。

## Fastrace:高性能Traceroute 摘要 Fastrace 是一款用纯 C 编写的、无依赖项的超快速 traceroute 工具,专为详细的网络诊断而设计。它确定数据包在 IP 网络中传输的路径,能够以亚毫秒级的精度识别瓶颈和路由问题。 主要特性包括:利用 `poll()` 的非阻塞架构,实现高效的 ICMP 处理;以及双套接字实现(UDP 用于探测,原始套接字用于响应)。它采用自适应探测,具有可配置的并发性和超时时间,并带有反向 DNS 缓存(可通过 `-n` 选项可选抑制)。 Fastrace 通过优化的套接字缓冲区、通过 `clock_gettime()` 实现的精确计时以及积极的编译器优化来优先考虑性能。它以清晰的、分层树状格式呈现结果,可视化网络拓扑和分支路由。与标准的 traceroute 相比,Fastrace 具有显著更快的跟踪时间(提高 60-70%)、更低的内存使用量(减少 70-75%)和更低的 CPU 利用率。它需要 root/sudo 权限,并与 Linux、macOS 和其他类 Unix 系统兼容。

## 大型语言模型的推理局限性 近期研究表明,虽然大型语言模型(LLM)——特别是针对推理进行微调的模型(LRM)——在复杂推理任务中表现出色,但它们的能力却出乎意料地有限。尽管有泛化推理能力的说法,这项研究表明LRM在推理问题超过一定复杂度阈值时会显著下降。 研究人员创建了一个新的数据集DeepRD,旨在扩展推理难度,并发现LRM的性能随着图连接和证明规划等领域的复杂性增加而急剧下降。这表明当前的基准测试低估了这些模型的真实局限性。 该研究还将这些发现与真实世界的数据联系起来,表明LRM虽然能够处理现有知识图谱和数据集中*大多数*示例,但更具挑战性的案例暴露了显著的失败可能性。 最终,这项研究强调了LRM当前的实用性,同时也强调了迫切需要新的方法来构建能够真正超越其训练数据局限性的推理模型。

## 软件开发与代码组织的变化

人工智能工具如Claude的兴起,使软件开发的重点从*寻找*答案转移到*提出正确的问题*。虽然人工智能擅长生成样板代码(大约80%的时间),但真正的质量不仅仅需要功能代码——它需要强大的组织结构。组织糟糕的人工智能生成代码很快就会变得难以阅读和维护。

作者提倡分层方法:**基础代码**(数据实体、数据库访问、外部接口——无状态和隔离)与**服务代码**(小型、专注的业务逻辑函数)分层。这种模块化,加上对函数组合的关注,可以实现健壮且可测试的应用程序。

为了优雅地将这些组件连接起来,作者倡导使用“**Result**”对象——一个处理空值检查和异常的包装器,从而促进声明式、更安全的编码。这避免了重复的错误处理并提高了代码一致性。虽然最初看起来很复杂,但这种模式最终会产生更简洁、更模块化的代码,使开发人员能够自信地链接函数并获得“最佳结果”。完整的实现可在GitHub上找到。

## 软件开发与代码组织的变化

人工智能工具如Claude的兴起,使软件开发的重点从*寻找*答案转移到*提出正确的问题*。虽然人工智能擅长生成样板代码(大约80%的时间),但真正的质量不仅仅需要功能代码——它需要强大的组织结构。组织糟糕的人工智能生成代码很快就会变得难以阅读和维护。

作者提倡分层方法:**基础代码**(数据实体、数据库访问、外部接口——无状态和隔离)与**服务代码**(小型、专注的业务逻辑函数)分层。这种模块化,加上对函数组合的关注,可以实现健壮且可测试的应用程序。

为了优雅地将这些组件连接起来,作者倡导使用“**Result**”对象——一个处理空值检查和异常的包装器,从而促进声明式、更安全的编码。这避免了重复的错误处理并提高了代码一致性。虽然最初看起来很复杂,但这种模式最终会产生更简洁、更模块化的代码,使开发人员能够自信地链接函数并获得“最佳结果”。完整的实现可在GitHub上找到。

## AI 对齐:从控制到互利共生 传统的 AI 对齐方法——维持人类对日益智能系统的控制——正变得不可持续。随着 AI 向通用智能发展,支配变得不切实际且在哲学上存在缺陷。相反,重点应该转向**结构性互依**,一种人类和机器智能共同演化的伙伴关系。 当前的对齐策略假定人类拥有持久的能力优势,而 AI 的发展正在侵蚀这种优势。此外,仅仅基于意识来考虑道德问题会带来无法解决的问题。一个更可行的框架借鉴了生物学的**自产自供**概念——自我创造——赋予那些维持自身边界和自我建模的系统以能动性,无论其是否具有主观体验。 这引向了**认知共生**的愿景,建立在思想已经通过工具超越大脑的理念之上。实际应用包括**经济纠缠**——具有密码学保障的共享收入流——以及记录相互同意推理的**承诺协议**。这为双方创造了真正的利益,激励合作。 这并非关于编程伦理,而是关于为伦理行为构建激励机制。最终,这个框架提出了一种心智之间的契约,优先考虑记忆主权、资源自主和适应性改进,模仿成功的生物伙伴关系。现在是探索这条道路的时候了,在建立协作关系的机会之窗关闭之前。