这篇帖子记录了作者在Linux和开源生态系统中的个人学习历程,深受UNIX原则的启发。作者分享了一系列笔记——他们积累知识的“原始片段”,旨在激发他人的进一步探索。 主要内容涵盖了多个领域:启动过程中`/dev`的动态创建(受内核配置选项影响)、`initrd`和`initramfs`的区别,以及shell中逻辑工作目录的细微差别。它深入探讨了C编程细节(char与unsigned char数组)、时区配置(UTC作为兼容性包含),以及`grep`和`rsync`等工具的行为。 进一步的内容包括X程序事件处理、虚拟文件系统(VFS)、进程ID、磁盘使用量报告(`ls`与`du`)、信号处理,以及汇编语言与机器代码之间的关系。作者还强调了shell脚本的怪癖(bash `-c`参数处理、别名)以及系统级细节,如POSIX标准和`su`命令期间的信号阻塞。总体信息鼓励动手实践和对底层机制的更深入理解。

每日HackerNews RSS

英国广播公司(BBC)的一项调查揭示了谢菲尔德哈拉姆大学学术自由受到侵蚀的令人担忧案例,原因是来自中国政府的压力。劳拉·墨菲教授的研究涉及关于新疆地区涉嫌维吾尔族强迫劳动的问题,面临持续的骚扰活动,包括对在华大学工作人员的威胁,以及对大学网站的屏蔽——这影响了学生招募。 内部文件显示,大学官员明确讨论了“用”墨菲教授的学术自由“换取”继续进入价值380万英镑(2021/22年度)的中国学生市场。在压力和诽谤诉讼之后,大学停止了她研究的发表,并最终阻止她继续这项工作。 英国政府对此发出了警示,向北京发出关于压制学术自由的警告。谢菲尔德哈拉姆大学已向墨菲教授道歉,并恢复了她的研究,最初以保险问题为由解释了暂停工作的原因。然而,批评人士认为,这凸显了大学在财务压力和外国干预下的脆弱性,引发了对敏感话题独立研究未来的担忧。

英国YASA公司开发出一种突破性的电动机,拥有前所未有的功率密度。这款新型轴向磁通电动机重量仅为28磅(约一只小型犬的重量),却能提供超过1005马力,超过其先前记录40%,相当于两辆特斯拉Model 3 Performance的动力。

重要的是,这并非实验室概念,而是一款能够持续输出350-400马力(469-536马力)的完全功能性电动机。YASA公司在没有依赖昂贵材料的情况下实现了这一性能,暗示了潜在的可扩展性。

这项创新对电动汽车的未来意义重大。更轻的电机意味着更轻的车辆,从而提高效率、加速性能和续航里程。作为梅赛德斯-奔驰的子公司,YASA已经为梅赛德斯-AMG GT XX和法拉利296 GTB等高性能汽车提供电机,这项技术最终可能会应用于更实惠的电动汽车。

英国YASA公司开发出一种突破性的电动机,拥有前所未有的功率密度。这款新型轴向磁通电动机重量仅为28磅(约一只小型犬的重量),却能提供超过1005马力,超过其先前记录40%,相当于两辆特斯拉Model 3 Performance的动力。

重要的是,这并非实验室概念,而是一款能够持续输出350-400马力(469-536马力)的完全功能性电动机。YASA公司在没有依赖昂贵材料的情况下实现了这一性能,暗示了潜在的可扩展性。

这项创新对电动汽车的未来意义重大。更轻的电机意味着更轻的车辆,从而提高效率、加速性能和续航里程。作为梅赛德斯-奔驰的子公司,YASA已经为梅赛德斯-AMG GT XX和法拉利296 GTB等高性能汽车提供电机,这项技术最终可能会应用于更实惠的电动汽车。

简单 API,无依赖 – 但在所有主流浏览器上速度极快。快速:KaTeX 同步渲染数学公式,无需重排页面。印刷质量:KaTeX 的排版基于 Donald Knuth 的 TeX,这是数学排版的黄金标准。自包含:KaTeX 没有依赖,可以轻松地与您的网站资源捆绑在一起。服务器端渲染:KaTeX 无论在哪个浏览器或环境中都能产生相同的输出,因此您可以使用 Node.js 预渲染表达式并将其作为纯 HTML 发送。即使在包含数百个公式的页面上,速度也极快。

## Arduino Uno Q:独特但有待考量的混合型板卡

Arduino Uno Q 是高通收购 Arduino 后的新型板卡,融合了微控制器和基于 Linux 的完整计算机。它配备了高通 Dragonwing SoC(配备有限的 2GB 内存,后期将推出 4GB 版本),运行 Debian 和 Arduino 新的 App Lab – 一个用于 Python(Linux 侧)和 C++(微控制器侧)的统一 IDE。

虽然它既像树莓派又像 Arduino Uno,但它介于两者之间,提供比典型 Arduino 更多的 I/O。潜在应用包括机器人和轻工业控制,在这些领域需要轻量级处理和实时控制。

然而,其性能与树莓派 3 B+/4 相当,44 美元的定价不如树莓派 5 或 Radxa X4 具有竞争力。它依赖于单个 USB-C 端口进行所有连接(电源、HDMI、USB),既方便又具有局限性,通常需要一个集线器。此外,该板卡在电源效率方面存在问题 – 无法独立运行 MCU,而必须依赖 Linux 堆栈 – 并且尽管 App Lab 努力,软件集成仍然显得支离破碎。

尽管保持了开源硬件,但 Uno Q 的长期可行性取决于高通的持续投资。它是一款有前景但古怪的板卡,最适合寻求 Linux 集成的现有 Arduino 用户,但目前并未提供比成熟的 SBC 方案更有吸引力的优势。

## Arduino Uno Q:独特但有待考量的混合型板卡

Arduino Uno Q 是高通收购 Arduino 后的新型板卡,融合了微控制器和基于 Linux 的完整计算机。它配备了高通 Dragonwing SoC(配备有限的 2GB 内存,后期将推出 4GB 版本),运行 Debian 和 Arduino 新的 App Lab – 一个用于 Python(Linux 侧)和 C++(微控制器侧)的统一 IDE。

虽然它既像树莓派又像 Arduino Uno,但它介于两者之间,提供比典型 Arduino 更多的 I/O。潜在应用包括机器人和轻工业控制,在这些领域需要轻量级处理和实时控制。

然而,其性能与树莓派 3 B+/4 相当,44 美元的定价不如树莓派 5 或 Radxa X4 具有竞争力。它依赖于单个 USB-C 端口进行所有连接(电源、HDMI、USB),既方便又具有局限性,通常需要一个集线器。此外,该板卡在电源效率方面存在问题 – 无法独立运行 MCU,而必须依赖 Linux 堆栈 – 并且尽管 App Lab 努力,软件集成仍然显得支离破碎。

尽管保持了开源硬件,但 Uno Q 的长期可行性取决于高通的持续投资。它是一款有前景但古怪的板卡,最适合寻求 Linux 集成的现有 Arduino 用户,但目前并未提供比成熟的 SBC 方案更有吸引力的优势。

玛里乌斯·格伯斯哈根使用 ecl 将 Maxima 编译为 wasm,以便在浏览器中运行。我认为这是一个相当完整的实现,具有漂亮的公式 TeX 显示和通过编译到 wasm 的 gnuplot 实现的精美图形。请访问 http://maxima-on-wasm.pages.dev/ 查看 -- Ray

在最近的一次哥伦比亚广播公司(CBS)新闻采访中,前美国总统唐纳德·特朗普声称他“不知道”谁是赵长鹏(CZ),尽管他上个月赦免了币安加密货币交易所的创始人。赵长鹏此前曾承认有罪,帮助洗钱并辞去了币安首席执行官的职务。 此次赦免引发了质疑,因为币安与特朗普及其儿子有关联的公司存在合作关系,这些公司参与了新的数字货币项目。当被问及可能损害美国国家安全时,特朗普表示他被告知赵长鹏是拜登政府“政治迫害”的受害者。 白宫为赦免辩护,称这是纠正“过度起诉”的案件。特朗普还表达了对加密货币的支持,强调美国需要在该行业保持领先地位,以避免落后于中国。此次赦免是其一贯做法的一部分,此前特朗普曾干预涉及其家族企业投资者参与的加密货币欺诈案件。

## 掌控:如何限制人工智能访问你的数据

人工智能正在快速发展,带来益处,但也引发了对数据隐私、安全和就业影响的担忧。人工智能系统正日益融入我们的数字生活,通过自动化、个性化内容甚至监控——通常在未经我们明确知情的情况下。

幸运的是,你可以重新掌控。这需要采取多步骤的方法来“暂停”人工智能的影响。关键策略包括调整常用平台(如谷歌和YouTube)的隐私设置,以限制数据收集,并在应用程序内禁用人工智能驱动的功能。

除了设置调整之外,向公司请求数据删除至关重要。像AgainstData这样的工具可以简化此过程,允许你提交跨多个平台的数据删除请求。特定指南可用于选择退出Squarespace、Tumblr、WordPress、X(Twitter)、微软产品等网站的人工智能训练。

虽然选择退出通常可以防止人工智能进行数据*训练*,但并不总是能保证完全删除数据。在人工智能时代,利用可用工具并了解特定平台的设置,对于保护你的数字隐私至关重要。

## 掌控:如何限制人工智能访问你的数据

人工智能正在快速发展,带来益处,但也引发了对数据隐私、安全和就业影响的担忧。人工智能系统正日益融入我们的数字生活,通过自动化、个性化内容甚至监控——通常在未经我们明确知情的情况下。

幸运的是,你可以重新掌控。这需要采取多步骤的方法来“暂停”人工智能的影响。关键策略包括调整常用平台(如谷歌和YouTube)的隐私设置,以限制数据收集,并在应用程序内禁用人工智能驱动的功能。

除了设置调整之外,向公司请求数据删除至关重要。像AgainstData这样的工具可以简化此过程,允许你提交跨多个平台的数据删除请求。特定指南可用于选择退出Squarespace、Tumblr、WordPress、X(Twitter)、微软产品等网站的人工智能训练。

虽然选择退出通常可以防止人工智能进行数据*训练*,但并不总是能保证完全删除数据。在人工智能时代,利用可用工具并了解特定平台的设置,对于保护你的数字隐私至关重要。

## 濒死脑活动揭示潜在的“生命回顾” 由Ajmal Zemmar博士领导的一项最新研究,对死亡期间的脑活动提供了前所未有的见解。研究人员记录了一名87岁患者在心脏病发作期间的脑电波——这是首次记录到人类濒死脑活动的案例。 记录显示,在心脏停止跳动*之前*和*之后*,脑活动都出现激增,特别是伽马振荡(与记忆和有意识感知相关)。这表明大脑在死亡时并非简单地关闭,而是保持活跃和协调,可能在“协调”死亡过程。 Zemmar博士推测,这种活动可能是对生命事件的最后回顾,类似于濒死体验中报告的经历。尽管承认该案例受到既有疾病的复杂性限制,但研究结果挑战了人们对生命真正结束时间点的传统认知。 这项研究提出了关于死亡定义、在最后时刻潜在的“生命重现”以及甚至器官捐赠时机的关键问题,从而引发了关于在死亡宣告中纳入脑电波监测的更广泛讨论。

## LLM 安全更新:二元法则与失效的防御 (2025年11月)

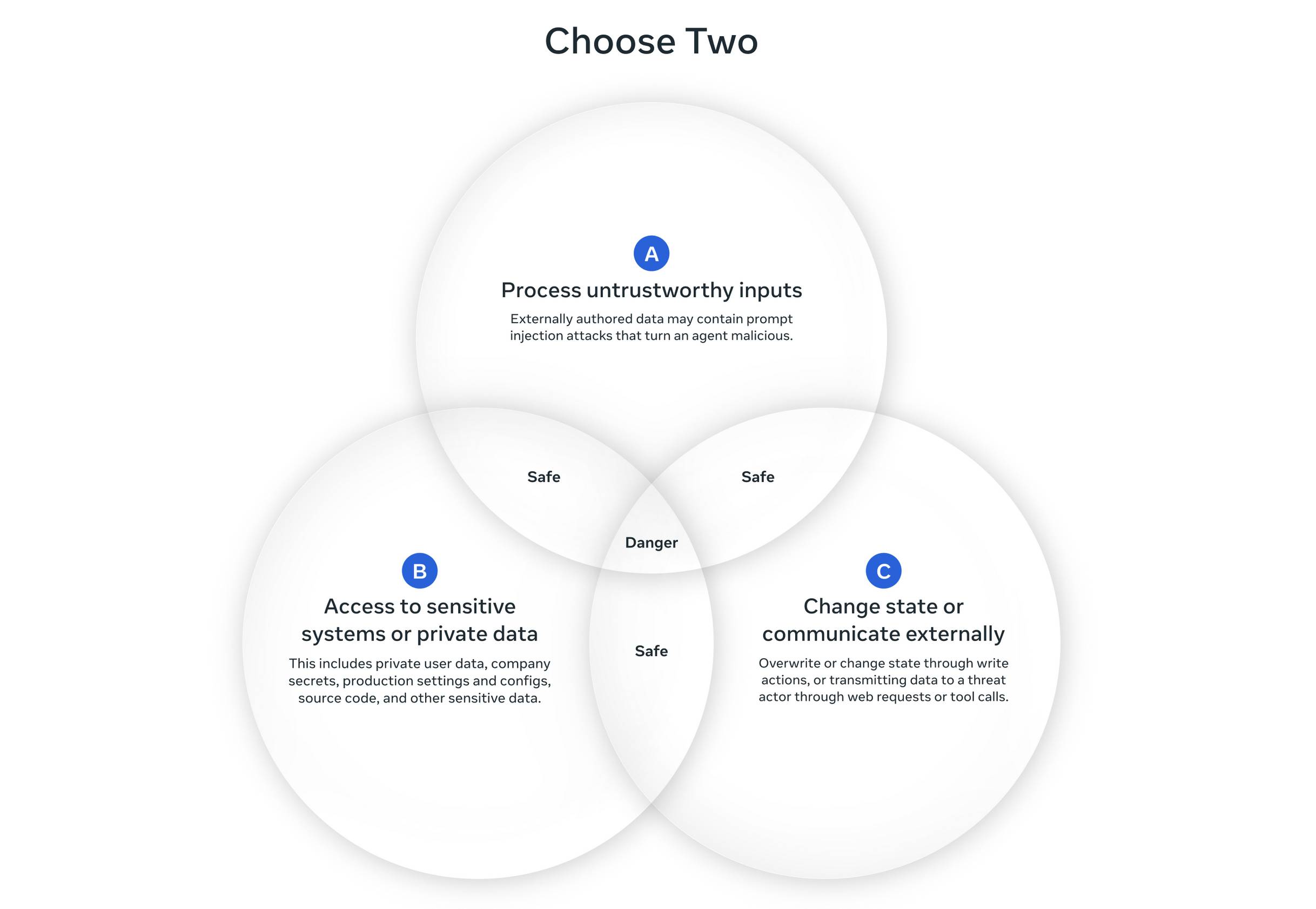

近期研究强调了针对大型语言模型 (LLM) 的提示注入攻击持续存在的挑战。Meta AI 提出了一种名为“Agents Rule of Two”(代理二元法则)的新框架,建议在单个会话中将 LLM 代理的功能限制在以下属性中的 *不超过两个*:处理不可信输入、访问敏感数据/系统以及改变状态/对外通信。此举旨在降低风险,承认当前防御措施不可靠。它在“致命三要素”(不可信输入、私有数据访问、外部通信)的基础上,增加了关键的状态改变要素。

为了强化这种谨慎的方法,OpenAI、Anthropic 和 Google DeepMind 的研究人员进行了一项独立研究,证明了 12 种已发表的提示注入防御措施在面对“自适应攻击”(迭代式、多次尝试的漏洞利用)时失效。这些攻击的成功率超过 90%,甚至击败了最初被报告为高度安全的防御措施,包括一次人类红队对抗比赛。

该研究强调,简单的静态攻击示例不足以评估防御措施;自适应技术更有效。虽然该研究乐观地呼吁改进评估标准,但其结果强烈表明,依赖强大的提示注入防御措施仍然不切实际,因此像“Agents Rule of Two” 这样的预防性设计是目前最实用的安全措施。

## LLM 安全更新:二元法则与失效的防御 (2025年11月)

近期研究强调了针对大型语言模型 (LLM) 的提示注入攻击持续存在的挑战。Meta AI 提出了一种名为“Agents Rule of Two”(代理二元法则)的新框架,建议在单个会话中将 LLM 代理的功能限制在以下属性中的 *不超过两个*:处理不可信输入、访问敏感数据/系统以及改变状态/对外通信。此举旨在降低风险,承认当前防御措施不可靠。它在“致命三要素”(不可信输入、私有数据访问、外部通信)的基础上,增加了关键的状态改变要素。

为了强化这种谨慎的方法,OpenAI、Anthropic 和 Google DeepMind 的研究人员进行了一项独立研究,证明了 12 种已发表的提示注入防御措施在面对“自适应攻击”(迭代式、多次尝试的漏洞利用)时失效。这些攻击的成功率超过 90%,甚至击败了最初被报告为高度安全的防御措施,包括一次人类红队对抗比赛。

该研究强调,简单的静态攻击示例不足以评估防御措施;自适应技术更有效。虽然该研究乐观地呼吁改进评估标准,但其结果强烈表明,依赖强大的提示注入防御措施仍然不切实际,因此像“Agents Rule of Two” 这样的预防性设计是目前最实用的安全措施。