## LLM 安全更新:二元法则与失效的防御 (2025年11月)

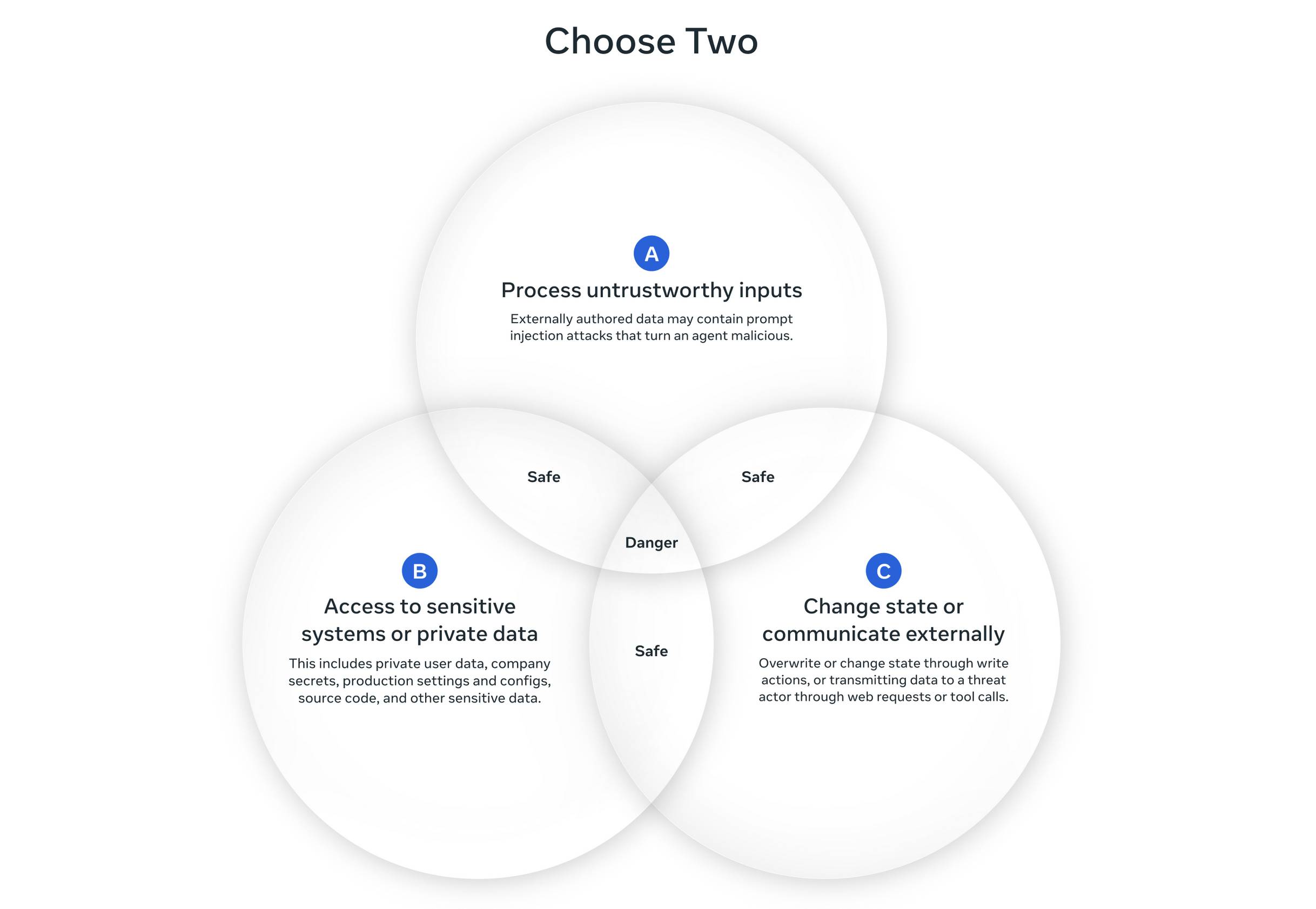

近期研究强调了针对大型语言模型 (LLM) 的提示注入攻击持续存在的挑战。Meta AI 提出了一种名为“Agents Rule of Two”(代理二元法则)的新框架,建议在单个会话中将 LLM 代理的功能限制在以下属性中的 *不超过两个*:处理不可信输入、访问敏感数据/系统以及改变状态/对外通信。此举旨在降低风险,承认当前防御措施不可靠。它在“致命三要素”(不可信输入、私有数据访问、外部通信)的基础上,增加了关键的状态改变要素。

为了强化这种谨慎的方法,OpenAI、Anthropic 和 Google DeepMind 的研究人员进行了一项独立研究,证明了 12 种已发表的提示注入防御措施在面对“自适应攻击”(迭代式、多次尝试的漏洞利用)时失效。这些攻击的成功率超过 90%,甚至击败了最初被报告为高度安全的防御措施,包括一次人类红队对抗比赛。

该研究强调,简单的静态攻击示例不足以评估防御措施;自适应技术更有效。虽然该研究乐观地呼吁改进评估标准,但其结果强烈表明,依赖强大的提示注入防御措施仍然不切实际,因此像“Agents Rule of Two” 这样的预防性设计是目前最实用的安全措施。

## LLM 安全更新:二元法则与失效的防御 (2025年11月)

近期研究强调了针对大型语言模型 (LLM) 的提示注入攻击持续存在的挑战。Meta AI 提出了一种名为“Agents Rule of Two”(代理二元法则)的新框架,建议在单个会话中将 LLM 代理的功能限制在以下属性中的 *不超过两个*:处理不可信输入、访问敏感数据/系统以及改变状态/对外通信。此举旨在降低风险,承认当前防御措施不可靠。它在“致命三要素”(不可信输入、私有数据访问、外部通信)的基础上,增加了关键的状态改变要素。

为了强化这种谨慎的方法,OpenAI、Anthropic 和 Google DeepMind 的研究人员进行了一项独立研究,证明了 12 种已发表的提示注入防御措施在面对“自适应攻击”(迭代式、多次尝试的漏洞利用)时失效。这些攻击的成功率超过 90%,甚至击败了最初被报告为高度安全的防御措施,包括一次人类红队对抗比赛。

该研究强调,简单的静态攻击示例不足以评估防御措施;自适应技术更有效。虽然该研究乐观地呼吁改进评估标准,但其结果强烈表明,依赖强大的提示注入防御措施仍然不切实际,因此像“Agents Rule of Two” 这样的预防性设计是目前最实用的安全措施。

每日HackerNews RSS

将课程大纲与您喜爱的应用程序连接。将其用作知识来源、部署渠道或自动化操作和工作流程。🚀强大的集成多用途集成,可作为知识来源、渠道和操作Slack知识来源部署渠道操作/工作流程从Slack构建知识库,部署聊天机器人,触发Slack操作。Google Workspace知识来源操作/工作流程连接Google Drive、Gmail、Calendar和Docs作为知识来源。即将推出:Zapier、Make (Integromat)、GitHub、Microsoft Teams、Stripe、Zendesk、HubSpot等等。此外,还有自定义API集成,提供无限的可能性。

## 亚马逊打击 Fire Stick 盗版 亚马逊今天开始在全球范围内打击 Fire Stick 上的非法流媒体应用。Fire Stick 本身通常不允许盗版,但用户通过“侧载”官方应用商店以外的应用来绕过限制,从而访问付费电视、电影和直播体育赛事。 亚马逊与创意娱乐联盟 (ACE) 合作,现在将在设备层面阻止这些侧载应用,即使用户使用 VPN 也无法避免。现有的 Fire Stick 仍将允许侧载,但被识别为提供盗版内容的应用程序将停止运行。 此举正值流媒体服务成本上涨之际——Netflix、Disney+ 等公司最近提高了价格——这促使一些观众转向非法选择。然而,盗版存在风险,包括恶意软件、病毒、欺诈和潜在的法律后果。专家还警告说,黑客可能会利用这些非官方应用程序中的漏洞来访问个人数据,从而导致潜在的网络犯罪。 亚马逊鼓励使用合法替代方案,例如“服务轮换”——轮流订阅不同的平台——作为一种经济高效的解决方案。此次打击行动最初将在法国和德国推出,并将在全球范围内扩展到包括英国和美国。

## 介绍 Oxy:Cloudflare 的下一代代理框架 Cloudflare 很高兴推出 Oxy,一个用 Rust 构建的现代代理框架,为零信任网关和 iCloud 私人中继等项目提供支持。Oxy 利用 Cloudflare 广泛的代理经验,处理巨大的流量负载和最新的通信协议。 本质上,Oxy 是一个高度可定制的服务器,能够代理具有各种协议的流量,提供预定义的场景和紧密的基础设施集成。其主要优势在于*可编程性*——工程师可以控制代理的各个方面,从协议处理到路由和 DNS 解析。这允许快速开发;应用程序可以利用 Oxy 的扩展点和配置选项,用最少的代码构建。 Oxy 支持广泛的“入口”(ingress – HTTP, TCP, UDP, IP)和“出口”(egress – HTTP, UDP, TCP, IP),并能够进行多层流量处理,甚至可以动态“解封装”流量以进行更深入的分析。Oxy 采用安全性和性能为设计理念,使用 Rust 并大量依赖于开源依赖项,如 `hyper` 和 `tokio`。 Oxy 代表了 Cloudflare 对迭代开发和现代、可扩展架构的承诺,并将成为未来改进的基石。更多技术细节将在后续博文中分享。

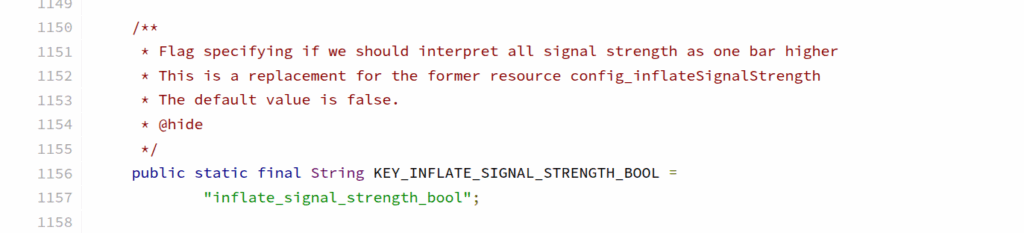

在Android系统中探索时,我发现了一个有趣的设置,位于运营商配置管理器中:一个标志(KEY_INFLATE_SIGNAL_STRENGTH_BOOL),用于始终向用户报告比实际信号强度高一格的信号。这个设置在Android文档中没有说明,但存在于源代码中,任何运营商都可以使用。值得注意的是,AT&T和Verizon已经在他们的网络上启用了这个标志。我不确定是谁要求将其添加到Android中的,也无法在git历史记录中找到相关信息,但我们可以在每个运营商的CarrierConfig中看到它,其中包含所有网络设置。运营商总是声称拥有最大的覆盖范围或最好的网络,但这种做法,以及虚假的5G标志,无助于建立信任,特别是考虑到神奇的手机天线,使得所有这些欺骗行为都变得不必要。

在Android系统中探索时,我发现了一个有趣的设置,位于运营商配置管理器中:一个标志(KEY_INFLATE_SIGNAL_STRENGTH_BOOL),用于始终向用户报告比实际信号强度高一格的信号。这个设置在Android文档中没有说明,但存在于源代码中,任何运营商都可以使用。值得注意的是,AT&T和Verizon已经在他们的网络上启用了这个标志。我不确定是谁要求将其添加到Android中的,也无法在git历史记录中找到相关信息,但我们可以在每个运营商的CarrierConfig中看到它,其中包含所有网络设置。运营商总是声称拥有最大的覆盖范围或最好的网络,但这种做法,以及虚假的5G标志,无助于建立信任,特别是考虑到神奇的手机天线,使得所有这些欺骗行为都变得不必要。

## 技术增长与员工数量的巨大脱钩

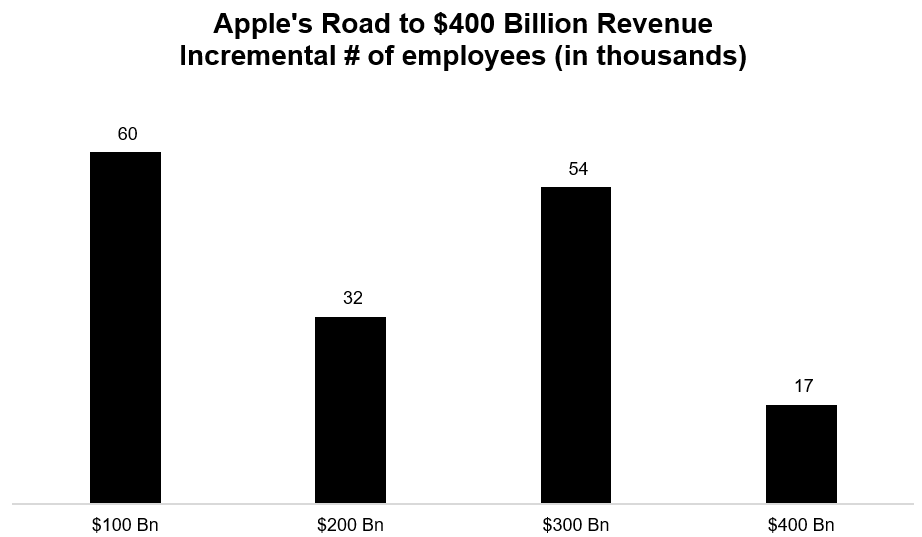

大型科技公司出现了一个显著趋势:收入增长与员工数量日益*脱钩*。 像惠普和IBM这样的公司曾经需要庞大的员工队伍才能实现1000亿美元的年收入(分别为17.2万和40万员工),而现代科技巨头却能以更少的人员实现类似的增长。

例如,苹果公司从1000亿美元规模增长到最近的增长,员工增加却大幅减少(最新的1000亿美元增长仅增加了约1.7万人)。Alphabet和微软也呈现出相似的模式——最近的1000亿美元收入增长仅需要增加1.1万和7000名员工。 即使是亚马逊,尽管疫情后过度招聘,但仍有望在员工数量小幅增加的情况下继续实现收入增长,这得益于人工智能驱动的效率提升。 Nvidia是这方面的典范,可能只需要增加6-8千名员工就能实现其下一个1000亿美元的收入。

这不仅仅局限于科技行业;沃尔玛的收入增长了2000亿美元,而员工数量却保持不变。 总体而言,这些公司仅需约10万名新员工就能创造约1万亿美元的新收入——这一趋势在生成式人工智能的充分影响显现*之前*就在加速。 这表明AGI可能是一个渐进式的演变,而不是颠覆性的事件,并影响投资策略,可能需要修改对OpenAI等公司的预期。 经济可能会向“微笑曲线”转变,使大型科技公司和个人创作者受益,而挤压中产阶级。

## 技术增长与员工数量的巨大脱钩

大型科技公司出现了一个显著趋势:收入增长与员工数量日益*脱钩*。 像惠普和IBM这样的公司曾经需要庞大的员工队伍才能实现1000亿美元的年收入(分别为17.2万和40万员工),而现代科技巨头却能以更少的人员实现类似的增长。

例如,苹果公司从1000亿美元规模增长到最近的增长,员工增加却大幅减少(最新的1000亿美元增长仅增加了约1.7万人)。Alphabet和微软也呈现出相似的模式——最近的1000亿美元收入增长仅需要增加1.1万和7000名员工。 即使是亚马逊,尽管疫情后过度招聘,但仍有望在员工数量小幅增加的情况下继续实现收入增长,这得益于人工智能驱动的效率提升。 Nvidia是这方面的典范,可能只需要增加6-8千名员工就能实现其下一个1000亿美元的收入。

这不仅仅局限于科技行业;沃尔玛的收入增长了2000亿美元,而员工数量却保持不变。 总体而言,这些公司仅需约10万名新员工就能创造约1万亿美元的新收入——这一趋势在生成式人工智能的充分影响显现*之前*就在加速。 这表明AGI可能是一个渐进式的演变,而不是颠覆性的事件,并影响投资策略,可能需要修改对OpenAI等公司的预期。 经济可能会向“微笑曲线”转变,使大型科技公司和个人创作者受益,而挤压中产阶级。

本文介绍了一种新型伪随机数生成器(PRNG),名为Collatz-Weyl生成器。它基于Collatz猜想和Weyl序列构建,旨在提供高质量的随机性,并通过了严格的统计测试。 Collatz-Weyl生成器的主要优势包括:强大的数学基础、快速生成数字且延迟低(“高吞吐量”)、实现紧凑(适用于软件和硬件)、以及能够产生多个独立的随机流。作者还建议了其在密码学中的潜在应用。该研究自2023年12月首次提交以来,经过多次修改,最终于2024年12月发布了当前版本。

## 软件工程研究令人沮丧的现实

作者同时支持经验软件工程(ESE)和形式化方法(FM),开始了一段令人沮丧的研究旅程,旨在回答一个简单的问题:在开发过程的早期发现的bug修复成本是否更低?他发现,研究领域出乎意料地不可靠。

经常被引用的“事实”——例如,需求bug修复成本是后期的100倍——通常缺乏可追溯的来源,源于未经证实的说法或过时的研究。即使获取原始研究也很困难,受到付费墙的阻碍,以及学术数据库和术语的复杂性。

此外,许多现有研究存在缺陷,依赖于过时的研究方法、狭窄的范围或可疑的统计分析。即使是“好的”论文,定义往往不够清晰,并且基于小型、特定的数据集。尽管存在这些挑战,作者仍然认为ESE具有价值,认识到一些发现——例如代码审查和短迭代周期的好处——得到了持续的支持。

最终,虽然明确的答案仍然难以捉摸,但作者暂定结论是,后期bug *往往* 修复成本更高,特别是那些源于设计缺陷的bug。他强调,进行这项研究需要批判性思维和接受一定程度的不确定性,因为该领域是一个“巨大的、不连贯的悲伤混乱”。

## 软件工程研究令人沮丧的现实

作者同时支持经验软件工程(ESE)和形式化方法(FM),开始了一段令人沮丧的研究旅程,旨在回答一个简单的问题:在开发过程的早期发现的bug修复成本是否更低?他发现,研究领域出乎意料地不可靠。

经常被引用的“事实”——例如,需求bug修复成本是后期的100倍——通常缺乏可追溯的来源,源于未经证实的说法或过时的研究。即使获取原始研究也很困难,受到付费墙的阻碍,以及学术数据库和术语的复杂性。

此外,许多现有研究存在缺陷,依赖于过时的研究方法、狭窄的范围或可疑的统计分析。即使是“好的”论文,定义往往不够清晰,并且基于小型、特定的数据集。尽管存在这些挑战,作者仍然认为ESE具有价值,认识到一些发现——例如代码审查和短迭代周期的好处——得到了持续的支持。

最终,虽然明确的答案仍然难以捉摸,但作者暂定结论是,后期bug *往往* 修复成本更高,特别是那些源于设计缺陷的bug。他强调,进行这项研究需要批判性思维和接受一定程度的不确定性,因为该领域是一个“巨大的、不连贯的悲伤混乱”。