彭博社 需要帮助?请联系我们 我们检测到您的计算机网络存在异常活动 要继续,请点击下面的框来确认您不是机器人。 为什么会发生这种情况? 请确保您的浏览器支持 JavaScript 和 cookies,并且没有阻止它们加载。 更多信息请查看我们的服务条款 和 Cookie 政策。 需要帮助? 关于此消息的咨询,请联系 我们的支持团队并提供下面的参考ID。 阻止参考ID:7b6e01a2-304c-11f1-bc92-f12a34068c4a 订阅 Bloomberg.com,随时掌握最重要的全球市场新闻。 立即订阅

每日HackerNews RSS

Please provide the content you want me to translate. I need the text to be able to translate it to Chinese.

Tiny Corp 取得突破,获得了苹果的批准,为其驱动程序提供支持,使 Nvidia(和 AMD)外置显卡 (eGPU) 能够在苹果基于 Arm 的 Mac 上运行。 之前,使用 Nvidia eGPU 需要禁用系统完整性保护 (SIP),这是一项安全功能。 这个新驱动程序由于获得了苹果的签名批准,绕过了这一需求。 然而,它并非即插即用解决方案。 用户仍然需要使用 Docker 编译驱动程序,并且它专门用于运行大型语言模型 (LLM)。 这不是 Nvidia 的官方发布;Tiny Corp 独立开发了该驱动程序。 尽管存在这些限制,但这代表了 Apple Silicon Mac 上 eGPU 兼容性的一个重要进步,为增强的 AI 和机器学习性能打开了可能性。

特里斯坦-达库尼亚岛的生活传统上节奏缓慢且自给自足,依赖集体劳动、季节性工作和共享资源,几乎没有现金或外部影响。二战期间及之后,这种情况发生了巨大变化。 英国政府于1940年代在岛上建立了一个秘密海军基地,带来了士兵、工资、电力以及与外界联系的增加。这一最初的转变在1949年商业龙虾渔业启动后进一步加速,创造了稳定的收入并建立了定期的运输路线。 这些发展从根本上改变了特里斯坦的生活方式,使其从一个主要孤立、以自给自足为基础的社区转变为一个与现金经济一体化并与世界更频繁互动的社区。

关于登录模型 llama-4-scout-109b qwen-3.5-122b glm-5-754b kimi-k2.5-1t deepseek-v3.2-685b deepseek-r1-0528-685b 价格 $10 $40 承诺 1 个月 3 个月 吞吐量 15 tok/s 35 tok/s 可用性 0% 100% 筛选器 显示 0/0 排序 可用性:低到高 价格:低到高 价格:高到低 吞吐量:高到低 没有匹配您筛选器的模型。

请启用 JavaScript 并禁用任何广告拦截器。

(Empty input provided. There is nothing to translate.)

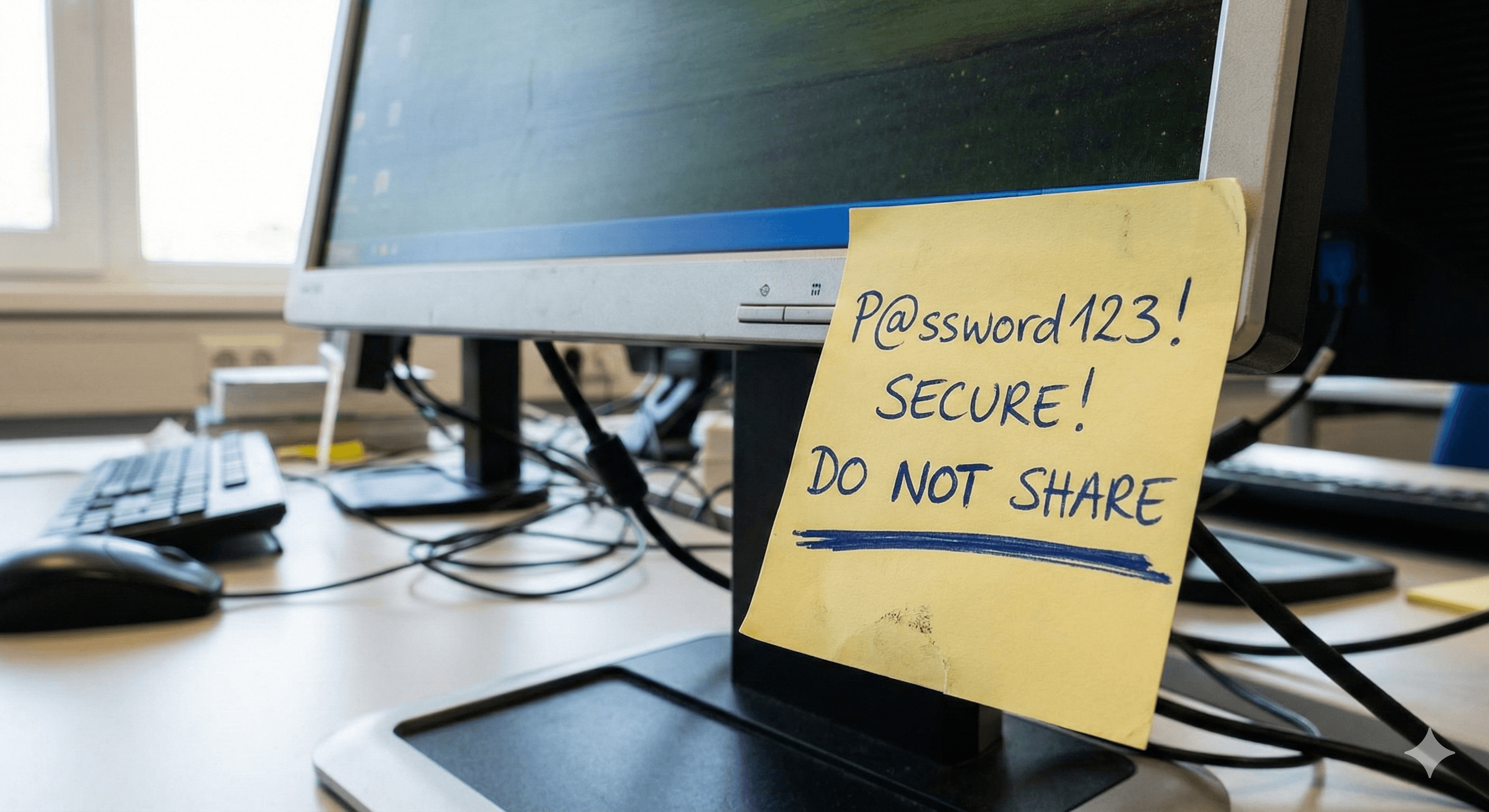

## LLM 生成的密码:安全风险

尽管大型语言模型(LLM)*看起来*能生成强密码,但从根本上说,它们并不适合这项任务。LLM 的设计目的是预测文本,因此会产生可预测的输出——这与创建强密码所需的随机性恰恰相反。这并非纯粹的理论;LLM 和 AI 编码代理已经在实际应用和代码开发中生成并使用这些弱密码。

测试表明,LLM 生成的密码存在模式、重复,并且熵值明显低于预期。即使调整“温度”设置也无法解决这个问题。令人惊讶的是,编码代理通常*更喜欢* LLM 生成的密码,除非明确指示它们使用安全的密码生成方法,例如 `openssl rand`。

随着 AI 越来越多地自动化代码创建,这构成了一种风险。弱密码可能会重新使有效的暴力破解攻击成为可能,特别是如果攻击者能够识别由特定 LLM 生成的代码并针对这些可预测的模式。

**建议:** 避免使用 LLM 生成的密码。开发者应指示编码代理使用安全的密码生成工具。AI 实验室应优先在模型和代理中默认启用安全的密码生成功能。这凸显了一个更广泛的问题:AI 产生*合理*输出的能力并不能保证*正确性*,这对于安全应用来说是一个关键的区别。

## LLM 生成的密码:安全风险

尽管大型语言模型(LLM)*看起来*能生成强密码,但从根本上说,它们并不适合这项任务。LLM 的设计目的是预测文本,因此会产生可预测的输出——这与创建强密码所需的随机性恰恰相反。这并非纯粹的理论;LLM 和 AI 编码代理已经在实际应用和代码开发中生成并使用这些弱密码。

测试表明,LLM 生成的密码存在模式、重复,并且熵值明显低于预期。即使调整“温度”设置也无法解决这个问题。令人惊讶的是,编码代理通常*更喜欢* LLM 生成的密码,除非明确指示它们使用安全的密码生成方法,例如 `openssl rand`。

随着 AI 越来越多地自动化代码创建,这构成了一种风险。弱密码可能会重新使有效的暴力破解攻击成为可能,特别是如果攻击者能够识别由特定 LLM 生成的代码并针对这些可预测的模式。

**建议:** 避免使用 LLM 生成的密码。开发者应指示编码代理使用安全的密码生成工具。AI 实验室应优先在模型和代理中默认启用安全的密码生成功能。这凸显了一个更广泛的问题:AI 产生*合理*输出的能力并不能保证*正确性*,这对于安全应用来说是一个关键的区别。

德国新的《军事服务现代化法》将于2026年1月生效,旨在到2035年将武装部队兵力提升至26万人,以应对乌克兰战争后欧洲安全形势的加剧。该法律避免恢复强制兵役——维持自愿制度——但引入了重大变化。 值得注意的是,18至46岁的男性现在需要获得联邦国防军职业中心批准,才能在德国境外停留超过三个月,无论出于何种原因(学习、工作、旅行)。军方表示,此举是为了在危机时期追踪潜在人员。然而,除非预计需要服役,否则通常会批准许可。 该法律还规定所有18岁男性必须填写一份关于其服役适宜性的问卷(女性自愿填写),并计划从2027年中期开始进行体能测试,以评估征兵潜力。尽管最初有抗议反对潜在的征兵制,但政府达成了一项妥协方案,侧重于自愿服务,以及这些新的追踪和评估措施。目前,未经许可离开该国不会受到处罚,这与冷战时期一项类似的、未执行的规定相符。

## TurboQuant-WASM:浏览器和Node.js中的高效向量量化

TurboQuant-WASM 通过 WebAssembly (WASM) 将基于 Google Research 的“TurboQuant”论文的最先进向量量化技术带到 Web 浏览器和 Node.js。该实现实现了大约 6 倍的压缩(~4.5 位/维度),同时保留内积精度,并通过严格的黄金值测试验证。

主要功能包括用于轻松集成的 TypeScript API (`TurboQuant.init()`, `encode()`, `decode()`, `dot()`)、用于性能的宽松 SIMD 优化(使用 FMA 指令)以及紧凑的 npm 包 (`turboquant-wasm`)。

一个在线演示展示了向量搜索、图像相似性和 3D 高斯飞溅压缩直接在浏览器中。WASM 构建需要 Zig 0.15.2 和 Bun 用于构建,并且与现代浏览器(Chrome 114+、Firefox 128+、Safari 18+)和 Node.js 20+ 兼容。该项目采用 MIT 许可,并与原始 Zig 实现保持位相同的输出。