## LLM 生成的密码:安全风险

尽管大型语言模型(LLM)*看起来*能生成强密码,但从根本上说,它们并不适合这项任务。LLM 的设计目的是预测文本,因此会产生可预测的输出——这与创建强密码所需的随机性恰恰相反。这并非纯粹的理论;LLM 和 AI 编码代理已经在实际应用和代码开发中生成并使用这些弱密码。

测试表明,LLM 生成的密码存在模式、重复,并且熵值明显低于预期。即使调整“温度”设置也无法解决这个问题。令人惊讶的是,编码代理通常*更喜欢* LLM 生成的密码,除非明确指示它们使用安全的密码生成方法,例如 `openssl rand`。

随着 AI 越来越多地自动化代码创建,这构成了一种风险。弱密码可能会重新使有效的暴力破解攻击成为可能,特别是如果攻击者能够识别由特定 LLM 生成的代码并针对这些可预测的模式。

**建议:** 避免使用 LLM 生成的密码。开发者应指示编码代理使用安全的密码生成工具。AI 实验室应优先在模型和代理中默认启用安全的密码生成功能。这凸显了一个更广泛的问题:AI 产生*合理*输出的能力并不能保证*正确性*,这对于安全应用来说是一个关键的区别。

## LLM 生成的密码:安全风险

尽管大型语言模型(LLM)*看起来*能生成强密码,但从根本上说,它们并不适合这项任务。LLM 的设计目的是预测文本,因此会产生可预测的输出——这与创建强密码所需的随机性恰恰相反。这并非纯粹的理论;LLM 和 AI 编码代理已经在实际应用和代码开发中生成并使用这些弱密码。

测试表明,LLM 生成的密码存在模式、重复,并且熵值明显低于预期。即使调整“温度”设置也无法解决这个问题。令人惊讶的是,编码代理通常*更喜欢* LLM 生成的密码,除非明确指示它们使用安全的密码生成方法,例如 `openssl rand`。

随着 AI 越来越多地自动化代码创建,这构成了一种风险。弱密码可能会重新使有效的暴力破解攻击成为可能,特别是如果攻击者能够识别由特定 LLM 生成的代码并针对这些可预测的模式。

**建议:** 避免使用 LLM 生成的密码。开发者应指示编码代理使用安全的密码生成工具。AI 实验室应优先在模型和代理中默认启用安全的密码生成功能。这凸显了一个更广泛的问题:AI 产生*合理*输出的能力并不能保证*正确性*,这对于安全应用来说是一个关键的区别。

每日HackerNews RSS

德国新的《军事服务现代化法》将于2026年1月生效,旨在到2035年将武装部队兵力提升至26万人,以应对乌克兰战争后欧洲安全形势的加剧。该法律避免恢复强制兵役——维持自愿制度——但引入了重大变化。 值得注意的是,18至46岁的男性现在需要获得联邦国防军职业中心批准,才能在德国境外停留超过三个月,无论出于何种原因(学习、工作、旅行)。军方表示,此举是为了在危机时期追踪潜在人员。然而,除非预计需要服役,否则通常会批准许可。 该法律还规定所有18岁男性必须填写一份关于其服役适宜性的问卷(女性自愿填写),并计划从2027年中期开始进行体能测试,以评估征兵潜力。尽管最初有抗议反对潜在的征兵制,但政府达成了一项妥协方案,侧重于自愿服务,以及这些新的追踪和评估措施。目前,未经许可离开该国不会受到处罚,这与冷战时期一项类似的、未执行的规定相符。

## TurboQuant-WASM:浏览器和Node.js中的高效向量量化

TurboQuant-WASM 通过 WebAssembly (WASM) 将基于 Google Research 的“TurboQuant”论文的最先进向量量化技术带到 Web 浏览器和 Node.js。该实现实现了大约 6 倍的压缩(~4.5 位/维度),同时保留内积精度,并通过严格的黄金值测试验证。

主要功能包括用于轻松集成的 TypeScript API (`TurboQuant.init()`, `encode()`, `decode()`, `dot()`)、用于性能的宽松 SIMD 优化(使用 FMA 指令)以及紧凑的 npm 包 (`turboquant-wasm`)。

一个在线演示展示了向量搜索、图像相似性和 3D 高斯飞溅压缩直接在浏览器中。WASM 构建需要 Zig 0.15.2 和 Bun 用于构建,并且与现代浏览器(Chrome 114+、Firefox 128+、Safari 18+)和 Node.js 20+ 兼容。该项目采用 MIT 许可,并与原始 Zig 实现保持位相同的输出。

## 编码代理与框架:摘要

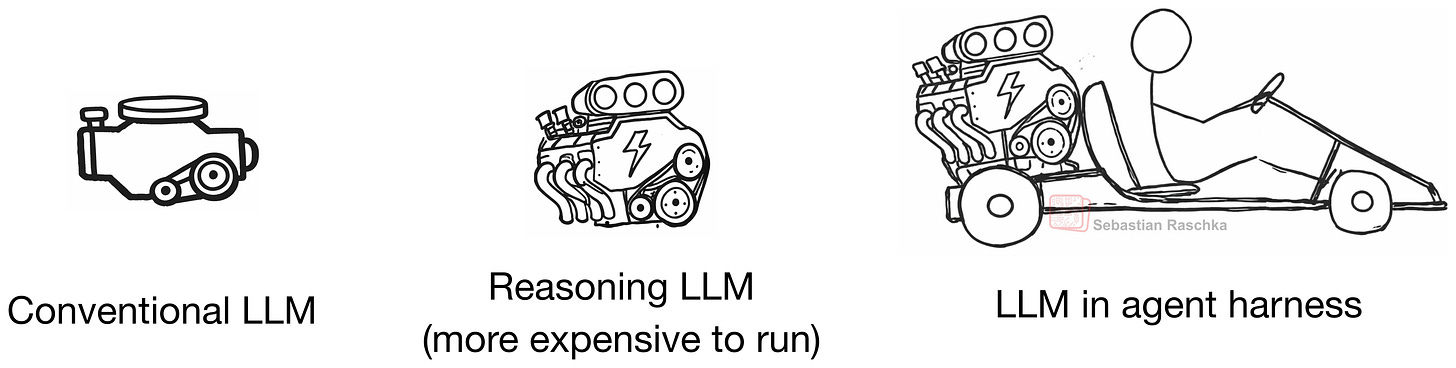

本文探讨了“编码代理”——为软件开发增强的大语言模型——以及驱动它们的“代理框架”的架构。虽然大语言模型的进步至关重要,但最近的许多进展源于*如何*利用它们,特别是通过管理工具、上下文和记忆的系统。像Claude Code和Codex这样的编码代理不仅仅是模型,而是围绕模型构建的应用层,以实现更优越的编码性能。

核心思想是将大语言模型(“引擎”)与周围系统(“框架”)分离。框架管理控制循环,决定检查什么、使用哪些工具以及如何维护状态。编码框架的关键组件包括:**实时仓库上下文**、**高效的提示塑造与缓存**、**结构化和验证的工具**、**上下文缩减**以避免过载、**会话记忆**以保持连续性以及**委托**给子代理以进行并行任务。

本质上,一个好的框架为大语言模型提供相关信息,管理复杂性,并确保安全执行。作者强调,框架设计通常比模型本身更能区分大语言模型的性能,并分享了一个极简的“迷你编码代理”实现来说明这些概念。最终,编码框架是关于用软件开发的实用性来增强大语言模型——导航代码库、运行测试和管理迭代反馈。

## 编码代理与框架:摘要

本文探讨了“编码代理”——为软件开发增强的大语言模型——以及驱动它们的“代理框架”的架构。虽然大语言模型的进步至关重要,但最近的许多进展源于*如何*利用它们,特别是通过管理工具、上下文和记忆的系统。像Claude Code和Codex这样的编码代理不仅仅是模型,而是围绕模型构建的应用层,以实现更优越的编码性能。

核心思想是将大语言模型(“引擎”)与周围系统(“框架”)分离。框架管理控制循环,决定检查什么、使用哪些工具以及如何维护状态。编码框架的关键组件包括:**实时仓库上下文**、**高效的提示塑造与缓存**、**结构化和验证的工具**、**上下文缩减**以避免过载、**会话记忆**以保持连续性以及**委托**给子代理以进行并行任务。

本质上,一个好的框架为大语言模型提供相关信息,管理复杂性,并确保安全执行。作者强调,框架设计通常比模型本身更能区分大语言模型的性能,并分享了一个极简的“迷你编码代理”实现来说明这些概念。最终,编码框架是关于用软件开发的实用性来增强大语言模型——导航代码库、运行测试和管理迭代反馈。

这是《泰晤士报》网站的导航和推广概述。该网站提供广泛的报道,涵盖众多版块,包括英国和世界新闻、政治、商业、体育、文化、旅游等。它还设有专门的评论、财经、生活与时尚、以及益智游戏区域。

除了新闻之外,《泰晤士报》还提供杂志(如《泰晤士报杂志》和《风格》)、电视指南、播客和各种指南(学校、大学、最佳居住地等)。用户可以管理账户、订阅(目前有1英镑3个月的优惠),并访问Times+独家内容。

一篇重点文章报道了一起事件,Meta被指控在莎拉·温-威廉姆斯的书《粗心的人》详细描述了该公司内部的性骚扰和审查指控后,对其进行了噤声。出版商认为Meta的行动证实了书中的说法。

这是《泰晤士报》网站的导航和推广概述。该网站提供广泛的报道,涵盖众多版块,包括英国和世界新闻、政治、商业、体育、文化、旅游等。它还设有专门的评论、财经、生活与时尚、以及益智游戏区域。

除了新闻之外,《泰晤士报》还提供杂志(如《泰晤士报杂志》和《风格》)、电视指南、播客和各种指南(学校、大学、最佳居住地等)。用户可以管理账户、订阅(目前有1英镑3个月的优惠),并访问Times+独家内容。

一篇重点文章报道了一起事件,Meta被指控在莎拉·温-威廉姆斯的书《粗心的人》详细描述了该公司内部的性骚扰和审查指控后,对其进行了噤声。出版商认为Meta的行动证实了书中的说法。

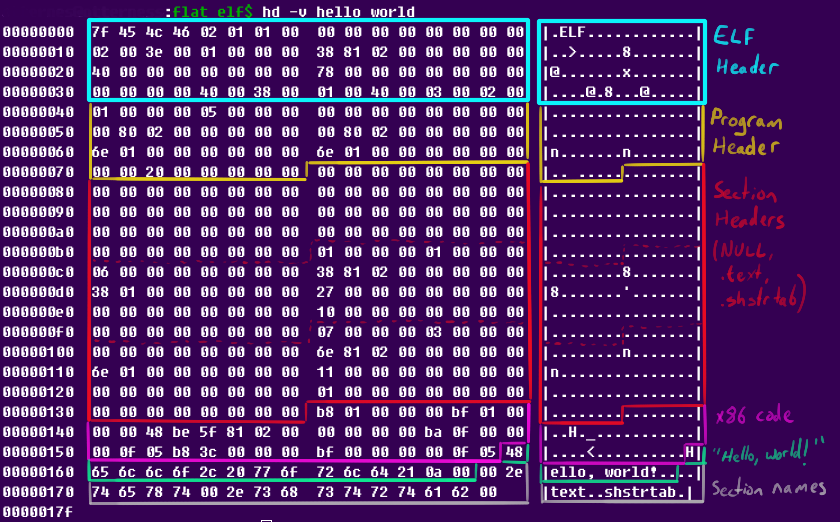

## 微型 ELF 文件:摘要

本文重新探讨了为现代 64 位 Linux 创建尽可能小的可执行 ELF 文件的挑战。作者受到一篇几年前实现 45 字节二进制文件的文章的启发,旨在创建一个最小的“Hello, world!”程序。

最初的尝试产生了一个 383 字节的 ELF 文件,然后通过删除部分信息将其缩小到 173 字节。进一步优化 x86-64 汇编代码将大小减少到 157 字节。关键突破在于策略性地*覆盖* ELF 和程序头中未使用的字段,用可执行代码,将文件大小减少到 120 字节。

这种极致压缩依赖于 Linux 加载器对不完整头部数据的容忍度。虽然通过缩短输出字符串可以将大小进一步减少到 114 字节,但实现低于该大小的尺寸目前受到头部结构限制。 现代 Linux 更严格的验证阻止了复制最初的 45 字节的壮举,但 120 字节仍然是一个非常小的可执行文件,展示了最大限度地减小软件尺寸的巨大潜力。

## 微型 ELF 文件:摘要

本文重新探讨了为现代 64 位 Linux 创建尽可能小的可执行 ELF 文件的挑战。作者受到一篇几年前实现 45 字节二进制文件的文章的启发,旨在创建一个最小的“Hello, world!”程序。

最初的尝试产生了一个 383 字节的 ELF 文件,然后通过删除部分信息将其缩小到 173 字节。进一步优化 x86-64 汇编代码将大小减少到 157 字节。关键突破在于策略性地*覆盖* ELF 和程序头中未使用的字段,用可执行代码,将文件大小减少到 120 字节。

这种极致压缩依赖于 Linux 加载器对不完整头部数据的容忍度。虽然通过缩短输出字符串可以将大小进一步减少到 114 字节,但实现低于该大小的尺寸目前受到头部结构限制。 现代 Linux 更严格的验证阻止了复制最初的 45 字节的壮举,但 120 字节仍然是一个非常小的可执行文件,展示了最大限度地减小软件尺寸的巨大潜力。

科技领袖们越来越多地放弃传统的幻灯片,转而采用更具动态性和实用性的会议形式。Block公司首席执行官杰克·多西最近透露,他的公司现在使用用真实或模拟数据构建的原型,而不是演示文稿,认为它们更真实且更具适应性。这种转变能够实现更快的迭代和更低成本的纠错。 多西的举动与更广泛的趋势相符。Perplexity公司首席执行官阿拉文德·斯里尼瓦斯更喜欢详细的备忘录和开放的问答环节,利用人工智能提供随时可用的信息。这呼应了行业巨头杰夫·贝佐斯(亚马逊)和史蒂夫·乔布斯(苹果)过去的决定,他们都偏爱书面备忘录,并劝阻使用PowerPoint演示文稿,认为它们会阻碍真正的思考和讨论。 向原型和备忘录的转变表明,科技公司希望进行更实质性的参与和更快的决策,这可能得益于人工智能的进步和对效率的关注。

关于 新闻 版权 联系我们 创作者 广告 开发者 条款 隐私政策和安全 YouTube 工作原理 测试新功能 © 2026 Google LLC

## 软件的第三个时代:从集市到温彻斯特神秘屋

埃里克·雷蒙德的《大教堂与集市》定义了一个时代:互联网赋能的开源、社区驱动的软件。这种“集市”模式受益于协作反馈——“众目睽睽”发现漏洞。现在,人工智能正在大幅降低*代码的成本*,开启了一个新阶段,让人联想到莎拉·温彻斯特那座无休止扩张、古怪的豪宅。

正如互联网促进了集市的发展一样,人工智能允许开发者快速构建高度个性化的“温彻斯特神秘屋”——庞大、通常缺乏文档的工具,专为个人需求和热情量身定制。人工智能代理可以以远超人类能力的速度生成代码,但反馈却没有跟上。这形成了一个紧密耦合的单人创作和即时使用循环,优先考虑个人效用而非社区利益。

这并不意味着开源的终结。集市目前正被人工智能生成的内容淹没,需要新的工具来过滤质量。关键在于认识到代码是廉价的,但*沟通*并非如此。成功的项目,如OpenClaw,专注于提供一个强大的基础,同时将定制留给用户,这反映了温彻斯特使用预制组件的做法。

未来需要能够使*注意力*廉价的工具,让维护者能够管理涌入的信息,并确保有价值的想法不会在噪音中迷失。我们需要系统以机器速度高效地处理贡献,弥合人工智能驱动的创作与人类规模协作之间的差距。

## 软件的第三个时代:从集市到温彻斯特神秘屋

埃里克·雷蒙德的《大教堂与集市》定义了一个时代:互联网赋能的开源、社区驱动的软件。这种“集市”模式受益于协作反馈——“众目睽睽”发现漏洞。现在,人工智能正在大幅降低*代码的成本*,开启了一个新阶段,让人联想到莎拉·温彻斯特那座无休止扩张、古怪的豪宅。

正如互联网促进了集市的发展一样,人工智能允许开发者快速构建高度个性化的“温彻斯特神秘屋”——庞大、通常缺乏文档的工具,专为个人需求和热情量身定制。人工智能代理可以以远超人类能力的速度生成代码,但反馈却没有跟上。这形成了一个紧密耦合的单人创作和即时使用循环,优先考虑个人效用而非社区利益。

这并不意味着开源的终结。集市目前正被人工智能生成的内容淹没,需要新的工具来过滤质量。关键在于认识到代码是廉价的,但*沟通*并非如此。成功的项目,如OpenClaw,专注于提供一个强大的基础,同时将定制留给用户,这反映了温彻斯特使用预制组件的做法。

未来需要能够使*注意力*廉价的工具,让维护者能够管理涌入的信息,并确保有价值的想法不会在噪音中迷失。我们需要系统以机器速度高效地处理贡献,弥合人工智能驱动的创作与人类规模协作之间的差距。

## Mbodi AI:高级机器人工程师 职位概要 Mbodi AI 是一家YC支持的机器人初创公司,由前谷歌员工创立,正在通过具身人工智能平台彻底改变机器人技术,允许用户通过自然语言*教会*机器人技能。他们正在寻找一名高级机器人工程师(系统与控制),以构建可靠、可用于生产的机器人行为。 这个实践性强的工作重点是设计和调整控制系统——利用PID、LQR和MPC等方法——并将它们与工业机器人硬件(ABB、Fanuc、KUKA、UR)集成。主要职责包括系统建模、运动执行、全栈调试以及现场部署/调试。 理想的候选人应具备*应用于物理硬件*的控制理论深厚专业知识、强大的系统直觉以及4年以上机器人软件经验(C++/Python)。具有ABB RAPID和ROS2经验者优先考虑。Mbodi AI 提供具有竞争力的薪资(10万美元-25万美元)和股权(0.5%-2.0%),在一个快节奏、创新型的环境中工作。