## 动态规划:从20世纪50年代的基础到现代机器学习

尽管最近才受到重视,机器学习建立在源于1952年理查德·贝尔曼关于动态规划的数学概念之上。这为最优控制和强化学习奠定了基础,最初是为离散时间提出的,后来扩展到连续系统。值得注意的是,贝尔曼发现这种连续形式与19世纪的物理方程——汉密尔顿-雅可比方程——相对应,从而统一了连续强化学习、随机控制和扩散模型等领域。

这种联系使得我们可以将问题视为优化轨迹。例如,连续时间强化学习利用汉密尔顿-雅可比-贝尔曼方程来寻找最优策略。同样,训练扩散模型(一种强大的生成技术)可以被解释为随机最优控制问题,利用相同的底层数学结构。

最近的研究表明,可以通过使用策略迭代和Q学习数值求解这些方程,并根据既定的控制基准(如线性二次调节器和莫顿投资组合问题)进行验证,从而实现实际应用。这突出了贝尔曼的基础性工作如何继续推动现代机器学习的进步,尤其是在强化学习和生成建模方面。

每日HackerNews RSS

由于2026年的政治预算僵局和随之而来的部分政府停摆,航空旅行变得不可靠,促使作者乘坐Amtrak的Crescent列车从亚特兰大到华盛顿特区,参加NCAA篮球锦标赛。这段650英里、14个半小时的旅程与飞行的便利形成了鲜明对比,凸显了政治冲突如何轻易破坏人们习以为常的基础设施。

火车之旅成为对美国生活的反思,穿越不同的景观和社区。虽然缺乏航空旅行的速度和便利设施,但Amtrak提供了确定性和宽敞、轻松的体验。这段旅程也展现了美国社会的一个缩影,充满了寻找混乱机场可靠替代方案的旅行者。

作者将铁路旅行的历史与更广泛的主题联系起来,包括移民、经济转型以及汽车和航空工业的兴起。最终,这次经历强调了政治对日常生活的影响,以及在一个分裂国家中联系和韧性的持久价值。尽管政治僵局仍在持续,火车仍然继续前进,载着乘客前往他们的目的地。

## 人工智能现在主导互联网流量 一份来自网络安全公司Human Security的新报告显示,人工智能和机器人已经超过人类用户,成为互联网流量的主导力量——这是我们使用网络方式的一个里程碑式的转变。2025年,自动化流量的增长速度几乎是人类活动的八倍,激增了187%,这得益于ChatGPT、Gemini和Claude等大型语言模型的普及。 这并非一定意味着负面影响;自动化流量包括有用的功能,例如谷歌的AI概览。然而,这标志着一个根本性的变化——每一种互动背后都有一个人类用户的假设正在迅速消失。该报告强调了“代理型”人工智能的大幅增加,这种人工智能能够自主行动。 虽然准确量化机器人流量仍然具有挑战性,但基于超过一万亿次互动的的数据表明,机器正在成为在线的主导力量,这促使我们需要在一个日益由人工智能驱动的世界中建立信任和安全。

此档案包含来自 SAIL-DARTS 项目的软件,具体来说是 1975 年 1 月在 PDP-10 机器(SUMEX、KI-10)上使用 Interlisp 语言开发的程序代码。代码源自 Bruce Baumgart 的收藏,并在相关的博士论文(ADA155378.pdf)中有详细说明。 核心文件 – LT、TA、TB 和 CON6 – 旨在按顺序加载,其中 CON6 是较新的补充。该系统利用 256k 核心内存,Interlisp 本身占用 140k,但提供额外的“阴影空间”用于编译后的代码。 由于其 ARPA 资助,并且论文明确鼓励使用、修改和分发,因此认为该软件属于公共领域。更多文档和相关文件可以在 SAILDART 档案中找到([https://www.saildart.org/[AM,DBL]/](https://www.saildart.org/[AM,DBL]/)),有关 DBL 区域的信息可在 EURISKO 项目 wiki 上找到。Discord 服务器([https://discord.gg/vhsmVCwgvK](https://discord.gg/vhsmVCwgvK))可用于讨论。

## webminal.org:一个持续15年的Linux学习平台 webminal.org是一个非常坚固的在线平台,自2011年以来一直在浏览器中提供真实的Linux终端,运行在一个单独的8GB CentOS服务器上——没有云服务、微服务或自动扩展。该网站由一位自学Linux的开发者创建,旨在为练习命令和系统管理技能提供一个无风险的环境。 最近,webminal.org经过重新设计,采用了现代、轻量级的前端,现在提供“Root Labs”,利用用户模式Linux实现完全root权限和使用`fdisk`和`systemctl`等工具进行真实练习。一个实时命令滴答器显示匿名化的实时用户活动,由eBPF提供支持。 该平台使用一种故意过时的(但功能完善!)技术栈构建——Python 2.7、Flask 0.12.5和令人惊讶的强大的Shellinabox,已经服务了超过50万用户。完全由创始人的个人储蓄资助,webminal.org仍然是免费的,优先考虑学生的可访问性,并继续运行,只要它能帮助哪怕一个学习者。该项目正在寻求赞助,以升级服务器资源并扩展对其流行的Root Labs的访问权限。

![]() ## 演示场景中技艺的演变

演示场景,一种专注于在有限硬件上创作令人印象深刻的视听演示的亚文化,与复制和原创性有着复杂的关系。早期的艺术家经常“借用”图形——特别是来自像鲍里斯·瓦列霍这样的知名创作者的奇幻和科幻艺术——并非为了创新,而是为了展示他们一丝不苟地逐像素重现的*技巧*。扫描仪昂贵,因此手工像素化、抖动和抗锯齿等技艺至关重要,通常甚至比原创想法更重要。

这种最初被接受的做法逐渐演变。随着工具的改进(扫描仪、Photoshop)和普及,直接扫描并将作品冒充原创的行为出现,被认为是一种低地位的“作弊”。大约在2000年左右,人们开始重视原创性,尽管复制仍然存在。

今天,随着生成式人工智能的兴起,这场争论仍在继续。虽然有些人认为人工智能只是另一种工具,但演示场景中的许多人更看重*过程*以及通过专注的技艺赋予的独特“灵魂”。演示场景仍然是一个主要由自我管理的社区,重视技术技能、艺术表达以及对商业压力的抵制——这使得人工智能辅助创作成为一个备受争议的问题,通常被使用者所隐藏。最终,这个场景的蓬勃发展依赖于突破限制,并庆祝纯粹为了创作的乐趣。

## 演示场景中技艺的演变

演示场景,一种专注于在有限硬件上创作令人印象深刻的视听演示的亚文化,与复制和原创性有着复杂的关系。早期的艺术家经常“借用”图形——特别是来自像鲍里斯·瓦列霍这样的知名创作者的奇幻和科幻艺术——并非为了创新,而是为了展示他们一丝不苟地逐像素重现的*技巧*。扫描仪昂贵,因此手工像素化、抖动和抗锯齿等技艺至关重要,通常甚至比原创想法更重要。

这种最初被接受的做法逐渐演变。随着工具的改进(扫描仪、Photoshop)和普及,直接扫描并将作品冒充原创的行为出现,被认为是一种低地位的“作弊”。大约在2000年左右,人们开始重视原创性,尽管复制仍然存在。

今天,随着生成式人工智能的兴起,这场争论仍在继续。虽然有些人认为人工智能只是另一种工具,但演示场景中的许多人更看重*过程*以及通过专注的技艺赋予的独特“灵魂”。演示场景仍然是一个主要由自我管理的社区,重视技术技能、艺术表达以及对商业压力的抵制——这使得人工智能辅助创作成为一个备受争议的问题,通常被使用者所隐藏。最终,这个场景的蓬勃发展依赖于突破限制,并庆祝纯粹为了创作的乐趣。

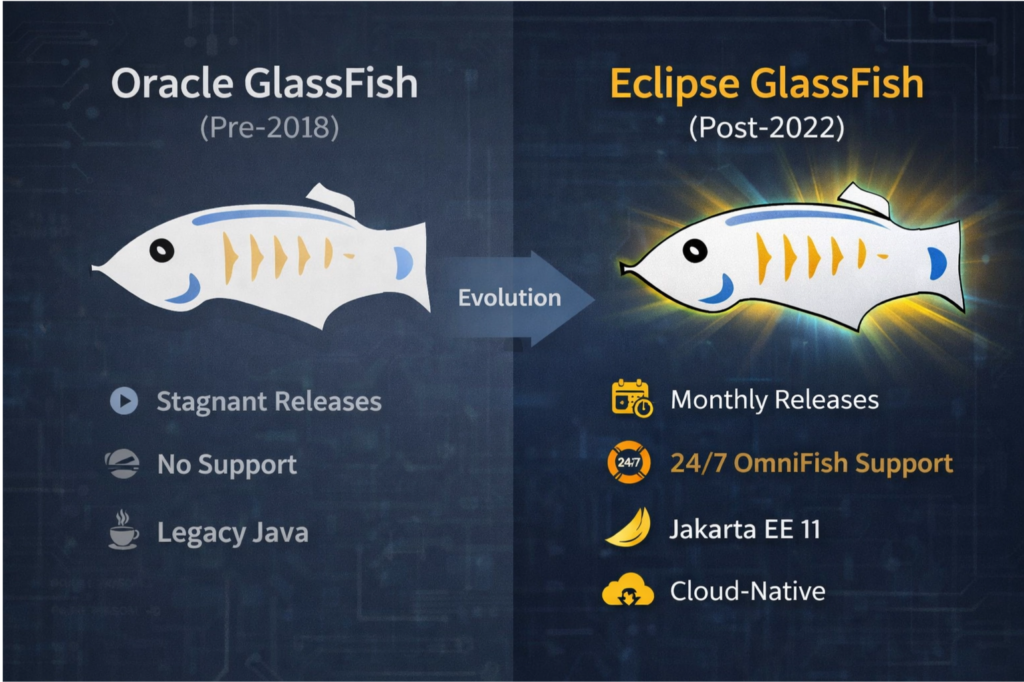

## Eclipse GlassFish:现代化平台

多年来,GlassFish一直饱受缓慢、缺乏支持且仅适用于开发的声誉。然而,自2022年以来,在Eclipse基金会的管理下,并得益于OmniFish的重大贡献,GlassFish已经发生了重大转变。现代Eclipse GlassFish(版本7.0及更高版本,最新版本为8.0)现在是一个强大、企业级的应用服务器。

主要改进包括来自OmniFish的积极商业支持和长期维护、频繁发布,以及对现代Java版本(高达25)和Jakarta EE 11的支持。与旧的Oracle GlassFish版本不同,它具有更快的性能、增强的安全功能,并且具有云就绪能力,提供Docker镜像和轻量级微服务分发版。

此外,Embedded GlassFish已经发展成为一个生产就绪的运行时环境,非常适合微服务。该平台现在积极支持MicroProfile API,提供健康检查和配置管理等功能。Eclipse GlassFish不再是一个过时的平台,而是满足当今企业Java需求的面向未来的解决方案。

## Eclipse GlassFish:现代化平台

多年来,GlassFish一直饱受缓慢、缺乏支持且仅适用于开发的声誉。然而,自2022年以来,在Eclipse基金会的管理下,并得益于OmniFish的重大贡献,GlassFish已经发生了重大转变。现代Eclipse GlassFish(版本7.0及更高版本,最新版本为8.0)现在是一个强大、企业级的应用服务器。

主要改进包括来自OmniFish的积极商业支持和长期维护、频繁发布,以及对现代Java版本(高达25)和Jakarta EE 11的支持。与旧的Oracle GlassFish版本不同,它具有更快的性能、增强的安全功能,并且具有云就绪能力,提供Docker镜像和轻量级微服务分发版。

此外,Embedded GlassFish已经发展成为一个生产就绪的运行时环境,非常适合微服务。该平台现在积极支持MicroProfile API,提供健康检查和配置管理等功能。Eclipse GlassFish不再是一个过时的平台,而是满足当今企业Java需求的面向未来的解决方案。

## 复制研究揭示关键创新聚集研究中的问题

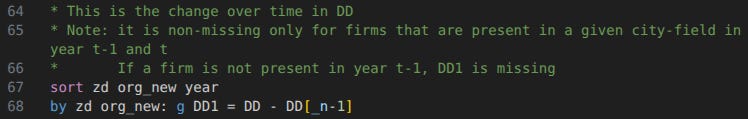

一篇最近被《美国经济评论》接受的评论详细指出了Moretti (2021) 的十个重大问题,该论文是一篇被高度引用的研究,探讨了技术集群规模与创新(专利产出)之间的联系。作者的复制研究对该论文的核心主张,即*因果*关系,提出了质疑,认为观察到的相关性可能并非因果关系。

批评的核心集中在Moretti尝试解决选择偏差(使用事件研究)和遗漏变量偏差(使用工具变量)中的缺陷。复制研究揭示了两种分析中的编码错误,更正后导致结果为零。其他问题包括由于数据合并错误导致的结果无法复现,不正确的统计计算影响了专利质量估计(显示质量随着集群规模的扩大而*下降*,与原始发现相反),以及对统计模型的误读。

作者最初受委托为住房政策资金扩展Moretti的研究,发现了许多编码和概念错误。这些错误范围从简单的数据处理错误到模型规范中的重大错误,显著改变了结论。研究结果表明,聚集的益处可能被夸大,并强调了在有影响力的研究中回应复制尝试的重要性。

## 复制研究揭示关键创新聚集研究中的问题

一篇最近被《美国经济评论》接受的评论详细指出了Moretti (2021) 的十个重大问题,该论文是一篇被高度引用的研究,探讨了技术集群规模与创新(专利产出)之间的联系。作者的复制研究对该论文的核心主张,即*因果*关系,提出了质疑,认为观察到的相关性可能并非因果关系。

批评的核心集中在Moretti尝试解决选择偏差(使用事件研究)和遗漏变量偏差(使用工具变量)中的缺陷。复制研究揭示了两种分析中的编码错误,更正后导致结果为零。其他问题包括由于数据合并错误导致的结果无法复现,不正确的统计计算影响了专利质量估计(显示质量随着集群规模的扩大而*下降*,与原始发现相反),以及对统计模型的误读。

作者最初受委托为住房政策资金扩展Moretti的研究,发现了许多编码和概念错误。这些错误范围从简单的数据处理错误到模型规范中的重大错误,显著改变了结论。研究结果表明,聚集的益处可能被夸大,并强调了在有影响力的研究中回应复制尝试的重要性。

![]() ## 硬件纹理压缩:一个新时代

硬件图像格式的创新历来缓慢,受到广泛硬件支持需求阻碍。然而,新的实时和硬件压缩技术正在改变这一局面。实时压缩允许更快地引入格式,因为它绕过了对现有内容的依赖。

目前,三种主要的硬件压缩格式正在出现:苹果的无损压缩(A15/M2芯片)、ARM的AFRC(Mali-G715/G615)和ImgTec的PVRIC4(Pixel 10)。苹果的格式易于实现,提供1:2压缩,质量良好,可与现有编解码器相媲美。ARM的AFRC以其灵活的压缩比和卓越的质量脱颖而出,甚至超过了实时ASTC编码。ImgTec的PVRIC4目前默认使用1:2压缩,测试表明质量较低。

性能测试表明,硬件压缩可以饱和内存带宽,通常与软件解决方案(如Spark)的速度相匹配或超过,尤其是在带宽受限的设备上。虽然AFRC目前在质量和性能方面领先,但硬件压缩仍然仅限于较新的设备。

最终,硬件压缩提供了一种引人注目的替代方案,但跨厂商的一致质量仍然是一个挑战,这使得像Spark这样的解决方案对于可预测的结果和潜在的未来WebGPU集成具有价值。

## 硬件纹理压缩:一个新时代

硬件图像格式的创新历来缓慢,受到广泛硬件支持需求阻碍。然而,新的实时和硬件压缩技术正在改变这一局面。实时压缩允许更快地引入格式,因为它绕过了对现有内容的依赖。

目前,三种主要的硬件压缩格式正在出现:苹果的无损压缩(A15/M2芯片)、ARM的AFRC(Mali-G715/G615)和ImgTec的PVRIC4(Pixel 10)。苹果的格式易于实现,提供1:2压缩,质量良好,可与现有编解码器相媲美。ARM的AFRC以其灵活的压缩比和卓越的质量脱颖而出,甚至超过了实时ASTC编码。ImgTec的PVRIC4目前默认使用1:2压缩,测试表明质量较低。

性能测试表明,硬件压缩可以饱和内存带宽,通常与软件解决方案(如Spark)的速度相匹配或超过,尤其是在带宽受限的设备上。虽然AFRC目前在质量和性能方面领先,但硬件压缩仍然仅限于较新的设备。

最终,硬件压缩提供了一种引人注目的替代方案,但跨厂商的一致质量仍然是一个挑战,这使得像Spark这样的解决方案对于可预测的结果和潜在的未来WebGPU集成具有价值。

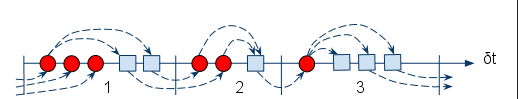

## VHDL 与 Verilog:确定性的关键

本文重点介绍了 VHDL 和 Verilog 之间的一个关键区别:**确定性**。VHDL 通过其“delta 循环”算法实现可预测的结果。该系统将信号更新和过程评估分为不同的阶段。信号更新首先发生,触发过程,然后过程更新信号——但这些更新被安排在*未来*的 delta 循环中。这确保了过程始终看到信号值的稳定快照,无论每个阶段内的执行顺序如何,从而保证了确定性的结果。

Verilog 缺乏这种分离。信号更新和过程评估可以交错进行,这意味着过程可能会根据执行顺序观察到不同的值,从而导致非确定性行为。虽然 Verilog 的非阻塞赋值*延迟*更新,但它们并未强制执行 VHDL 的分阶段方法。

作者认为 VHDL 的 delta 循环是其最强大的特性,以最小的开销提供内置的确定性。虽然 Verilog 可以通过使用非阻塞赋值在特定的同步设计中实现确定性,但这并非普遍保证。VHDL 依赖于信号进行过程间通信,而信号本质上利用了 delta 循环,这有助于其一致的行为,与 Verilog 依赖 `reg` 类型以及阻塞赋值与非阻塞赋值的复杂性形成了鲜明对比。

## VHDL 与 Verilog:确定性的关键

本文重点介绍了 VHDL 和 Verilog 之间的一个关键区别:**确定性**。VHDL 通过其“delta 循环”算法实现可预测的结果。该系统将信号更新和过程评估分为不同的阶段。信号更新首先发生,触发过程,然后过程更新信号——但这些更新被安排在*未来*的 delta 循环中。这确保了过程始终看到信号值的稳定快照,无论每个阶段内的执行顺序如何,从而保证了确定性的结果。

Verilog 缺乏这种分离。信号更新和过程评估可以交错进行,这意味着过程可能会根据执行顺序观察到不同的值,从而导致非确定性行为。虽然 Verilog 的非阻塞赋值*延迟*更新,但它们并未强制执行 VHDL 的分阶段方法。

作者认为 VHDL 的 delta 循环是其最强大的特性,以最小的开销提供内置的确定性。虽然 Verilog 可以通过使用非阻塞赋值在特定的同步设计中实现确定性,但这并非普遍保证。VHDL 依赖于信号进行过程间通信,而信号本质上利用了 delta 循环,这有助于其一致的行为,与 Verilog 依赖 `reg` 类型以及阻塞赋值与非阻塞赋值的复杂性形成了鲜明对比。