RamAIn是一家获得Y Combinator支持的初创公司,正在构建AI智能体来自动化重复的企业工作流程——以比人类快10倍且更可靠的速度运行遗留系统和应用程序。公司由前麦肯锡顾问Shourya Vir Jain和AI研究员Vansh Ramani(曾就职于CMU和Meta)创立,RamAIn将前沿研究与实用、可投入生产的系统相结合。 他们目前正在招聘创始AI/ML研究员,以开发能够进行复杂推理、规划和执行的智能体。该职位侧重于构建多模态模型以理解软件界面,并创建强大的动作选择系统。 这不仅仅是一个纯粹的研究职位;理想的候选人将快速原型设计、实验和部署模型,以自动化企业客户的实际任务。RamAIn寻找在智能体系统、机器学习或相关领域具有丰富实践经验,并对推动AI原生自动化的边界充满热情的人才。

每日HackerNews RSS

克利夫兰地下,嘉吉威士忌岛盐矿正不知疲倦地工作,以满足东北部和五大湖地区异常高的融雪盐需求,原因是比往年更严酷的冬季。这个巨大的矿井位于地下1800英尺处,由古代干涸的海域形成,每年开采300万至400万吨盐。

矿工们钻孔、爆破,并通过错综复杂的隧道输送着4.4亿年前的盐,每天生产约11,000至14,000吨的融雪剂。嘉吉报告称,自9月以来一直在加班加点,以应对减少的市政供应和频繁的暴风雪。

尽管需求增加,主管乔治·坎贝尔保证,矿井仍有数十年的储备。该矿井通过卡车、铁路和船只向多个州分发盐,优先向需求最大的地区供应,以应对持续的冬季天气。

![]() ## Raincast:AI驱动的桌面应用构建器

Raincast 是一款原生桌面应用程序,可以直接从自然语言描述生成功能完善、可发布的 Tauri 应用。只需描述您想要的应用——从实用工具到复杂的程序,例如 AI 聊天客户端甚至游戏——Raincast 就会构建具有真实 UI、后端功能和系统集成的应用。

它利用 AI(支持 Anthropic、Google Gemini,并可集成其他 AI)生成 React 前端和 Rust 后端,提供 9 个预构建的布局模板。一个独特的实时预览功能让您可以在开发*期间*看到您的应用运行,甚至可以访问文件系统和 shell 命令,这得益于巧妙的代理系统。

Raincast 可以编译为 macOS、Windows 和 Linux 的独立二进制文件,并提供一键发布选项。它可以通过简单的安装脚本或从其 GitHub 仓库手动构建获得。它是一个欢迎贡献的开源项目。

## Raincast:AI驱动的桌面应用构建器

Raincast 是一款原生桌面应用程序,可以直接从自然语言描述生成功能完善、可发布的 Tauri 应用。只需描述您想要的应用——从实用工具到复杂的程序,例如 AI 聊天客户端甚至游戏——Raincast 就会构建具有真实 UI、后端功能和系统集成的应用。

它利用 AI(支持 Anthropic、Google Gemini,并可集成其他 AI)生成 React 前端和 Rust 后端,提供 9 个预构建的布局模板。一个独特的实时预览功能让您可以在开发*期间*看到您的应用运行,甚至可以访问文件系统和 shell 命令,这得益于巧妙的代理系统。

Raincast 可以编译为 macOS、Windows 和 Linux 的独立二进制文件,并提供一键发布选项。它可以通过简单的安装脚本或从其 GitHub 仓库手动构建获得。它是一个欢迎贡献的开源项目。

启用 JavaScript 和 Cookie 以继续。

GitHub Copilot 因开始在开发者提交的拉取请求 (PR) 中插入推广“提示”——本质上是广告——而迅速受到批评,甚至这些 PR 最初并非由 Copilot 创建。澳大利亚开发者 Zach Manson 首先指出了这个问题,发现在使用 Copilot 修复一个拼写错误后,PR 中附加了一条 Raycast 广告。 数千个 PR 受此影响,只要提到 Copilot 的名字,它就会添加这些未经请求的推荐。开发者们对此感到愤怒,认为这种做法具有侵入性,并且滥用了人工智能工具。 GitHub 迅速做出回应,承认这种新行为——允许 Copilot 修改其不负责的 PR——是一个失误。虽然 Copilot 此前曾向其*自身*生成的 PR 添加提示,但将此扩展到其他人证明不受欢迎。GitHub 现在已在拉取请求中禁用了这些“提示”,撤销了该更改并为不想要的广告道歉。

围绕安全漏洞披露的争论——是立即公开缺陷(“完全披露”)还是保密(“不披露”)——已经基本定论为“负责任披露”,这是一种带有修复禁运期的协调方法。这种做法现在已成为国际标准。 然而,区块链技术的漏洞披露更为复杂。除了技术安全之外,区块链的价值还依赖于*公众信任*,而即使没有成功的攻击,散布恐惧、不确定性和怀疑(FUD)也可能损害公众信任。 本文解决了对区块链密码学量子攻击的更新估算。为了减轻FUD,作者首先阐明了区块链的免疫领域以及当前在量子抗性方面的进展。至关重要的是,他们用“零知识证明”来证实他们的发现,*而没有*泄露敏感的攻击细节,从而允许独立验证。 作者倡导继续讨论,以完善专门针对区块链技术所带来的独特挑战的负责任披露规范。

此网站正在使用安全服务来保护自身免受在线攻击。我们正在检查您的浏览器以建立安全连接并保护您安全。请启用JavaScript以继续。

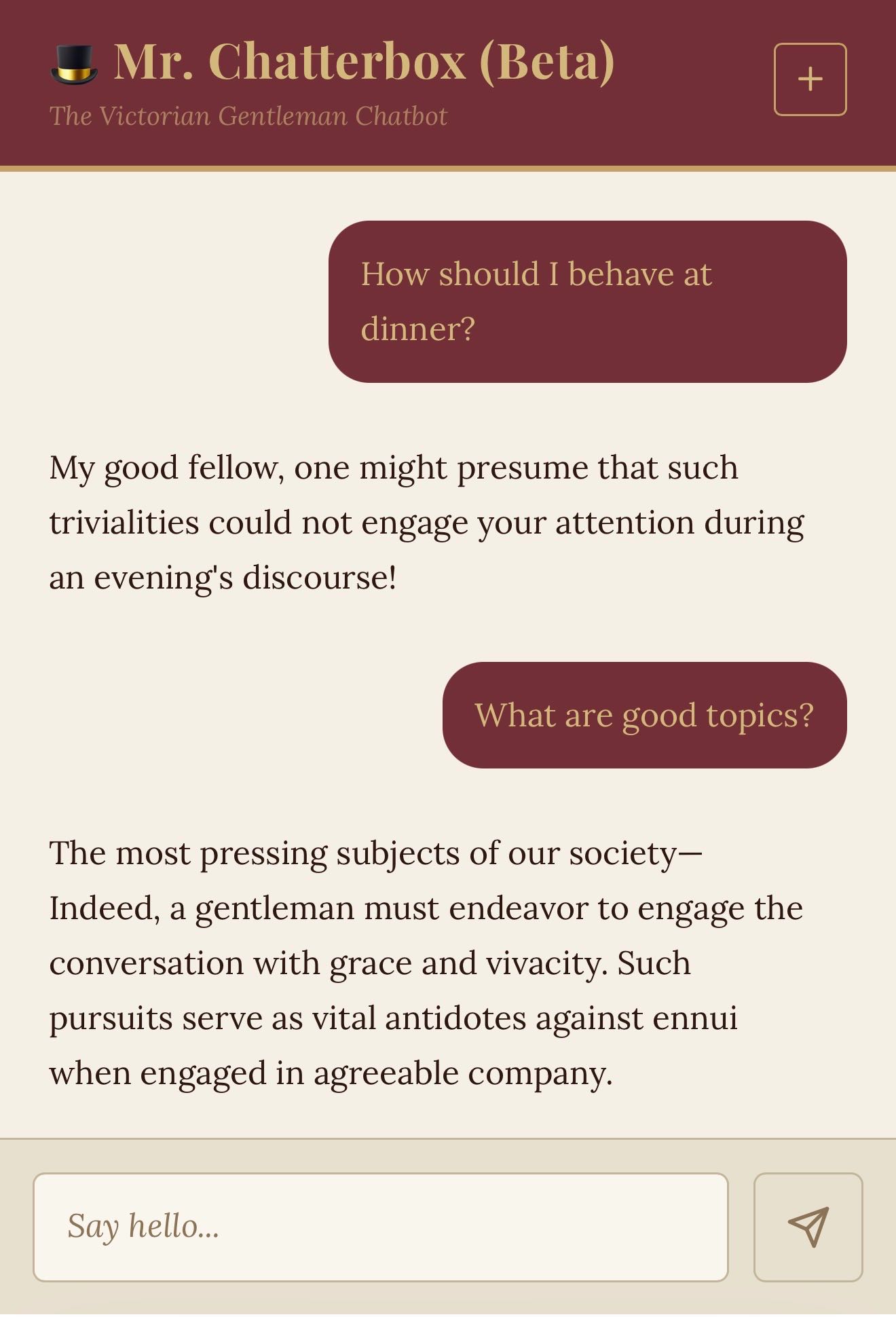

2026年3月,Trip Venturella发布了“Mr. Chatterbox”,一个独特的语言模型,仅使用来自英国图书馆的28,000多份维多利亚时代(1837-1899)的公共版权书籍进行训练。该模型拥有3.4亿个参数(类似于GPT-2 Medium),旨在展示在不依赖抓取和未经许可的数据的情况下构建LLM的潜力。

目前,Mr. Chatterbox的回复虽然具有独特的维多利亚风格,但还比较基础——更像一个马尔可夫链,而非一个复杂的LLM。开发者承认需要更多训练数据(估计超过70亿个token)才能实现真正的对话能力。

尽管存在局限性,该项目被认为是在完全公共领域资源的基础上构建LLM的一个有希望的步骤。一个名为“llm-mrchatterbox”的插件允许用户使用LLM框架在本地运行2.05GB的模型,展示了在Claude Code的帮助下,插件创建的成功自动化。你可以在[这里](链接到HuggingFace Spaces demo)试用演示。

2026年3月,Trip Venturella发布了“Mr. Chatterbox”,一个独特的语言模型,仅使用来自英国图书馆的28,000多份维多利亚时代(1837-1899)的公共版权书籍进行训练。该模型拥有3.4亿个参数(类似于GPT-2 Medium),旨在展示在不依赖抓取和未经许可的数据的情况下构建LLM的潜力。

目前,Mr. Chatterbox的回复虽然具有独特的维多利亚风格,但还比较基础——更像一个马尔可夫链,而非一个复杂的LLM。开发者承认需要更多训练数据(估计超过70亿个token)才能实现真正的对话能力。

尽管存在局限性,该项目被认为是在完全公共领域资源的基础上构建LLM的一个有希望的步骤。一个名为“llm-mrchatterbox”的插件允许用户使用LLM框架在本地运行2.05GB的模型,展示了在Claude Code的帮助下,插件创建的成功自动化。你可以在[这里](链接到HuggingFace Spaces demo)试用演示。

1982年,瑞典邮政发行了三枚邮票,其中包含奥斯卡·罗特斯瓦德的三幅不可能图形,包括他创作的第一个不可能三角形。这引发了他在祖国瑞典的声誉复兴。同年,一本收录了他作品的画册也出版了。尽管该画册已被翻译成多种语言,但罗特斯瓦德在全球范围内的知名度始终不如埃舍尔。问题在于他是否认为这是个问题。他的不可能图形主要是对一种探索的视觉表达,一种完全掌控他的痴迷的记录。直到1985年和1986年,布鲁诺·恩斯特才在他的著作《不可能图形探险》和《眼花缭乱:视觉错觉》中将两位艺术家联系在一起。与此同时,罗特斯瓦德坚持创作自己的不可能图形,直到2002年去世。

## Ollama 0.19:在 Apple Silicon 上更快的大语言模型

Ollama 的最新版本 (0.19) 通过利用 Apple 的 MLX 框架,为在 Apple Silicon 上运行大型语言模型提供了显著的性能提升。这带来了巨大的加速——在 M5 芯片上高达 1810 个 token/秒的预填充速度,这得益于利用 GPU 神经加速器。

主要更新包括对 NVIDIA 的 NVFP4 格式的支持,该格式提供更高质量的响应并减少内存使用,以及改进的缓存机制。这些缓存增强功能——智能检查点、更智能的驱逐和缓存重用——提高了响应速度,尤其是在编码和代理任务中。

Ollama 0.19 最初加速了 Qwen3.5-35B-A3B 模型(针对编码进行了优化),并且需要具有 32GB+ 统一内存的 Mac。未来的开发重点是扩展模型支持并简化自定义模型导入。此版本标志着在 Apple 设备上实现高效强大的本地 LLM 推理迈出了重要一步。

## Ollama 0.19:在 Apple Silicon 上更快的大语言模型

Ollama 的最新版本 (0.19) 通过利用 Apple 的 MLX 框架,为在 Apple Silicon 上运行大型语言模型提供了显著的性能提升。这带来了巨大的加速——在 M5 芯片上高达 1810 个 token/秒的预填充速度,这得益于利用 GPU 神经加速器。

主要更新包括对 NVIDIA 的 NVFP4 格式的支持,该格式提供更高质量的响应并减少内存使用,以及改进的缓存机制。这些缓存增强功能——智能检查点、更智能的驱逐和缓存重用——提高了响应速度,尤其是在编码和代理任务中。

Ollama 0.19 最初加速了 Qwen3.5-35B-A3B 模型(针对编码进行了优化),并且需要具有 32GB+ 统一内存的 Mac。未来的开发重点是扩展模型支持并简化自定义模型导入。此版本标志着在 Apple 设备上实现高效强大的本地 LLM 推理迈出了重要一步。